CData MCP Server でローカル LLM をリアルタイムデータに接続する

LM Studio は、大規模言語モデル(LLM)をローカル PC 上で実行できるデスクトップアプリケーションです。クラウドサービスやインターネットに依存することなく、オープンソースの AI モデルを直感的な操作でダウンロード、管理、検証できます。

CData MCP Server と組み合わせることで、静的なデータモデルに頼ることなく、LM Studio でリアルタイムデータとやり取りして実用的なインサイトを得られるようになります。CData MCP Server は LLM とあらゆるエンタープライズデータソース(データベース、SaaS アプリケーション、API など)をつなぐ架け橋として機能します。これにより、LM Studio は単なる AI の実験場から、分析・自動化・レポート作成を行う実運用環境へと進化します。

この記事では、ローカル LLM が注目を集めている理由を解説し、CData MCP Server を使って LM Studio をエンタープライズデータに接続する手順を詳しくご紹介します。

ローカル LLM が注目される理由

Meta の Llama や Alibaba Cloud の Qwen といったオープンソースの大規模言語モデル(LLM)は、エンタープライズ AI 市場で大きな注目を集めています。開発者のワークステーションやオンプレミスの GPU クラスターでこれらのモデルをローカル実行することで、企業は生成 AI のメリットを最大限に活用しながら、モデルの動作を完全にコントロールし、ベンダーロックインを回避し、厳格なデータプライバシーやコンプライアンスポリシーを遵守できます。

オープンソースモデルでは、モデルの重みとアーキテクチャに完全にアクセスできるため、開発チームは出力の微調整、プロンプトの改良、プロジェクト目標に合わせたカスタマイズを自由に行えます。この柔軟性から、ローカル LLM はワークフローや自動化にインテリジェンスを組み込む用途でますます活用されています。

ガイド:LM Studio をエンタープライズデータに接続する

MCP の実際の動作を示すため、Qwen3 14B モデルを LM Studio でローカル実行し、CData MCP Server for Salesforce と連携させる例をご紹介します。

前提条件

- CData MCP Server をインストールしてください(この例では Salesforce を使用します)

- LM Studio をインストールしてください

ステップ 1:MCP Server の接続を設定する

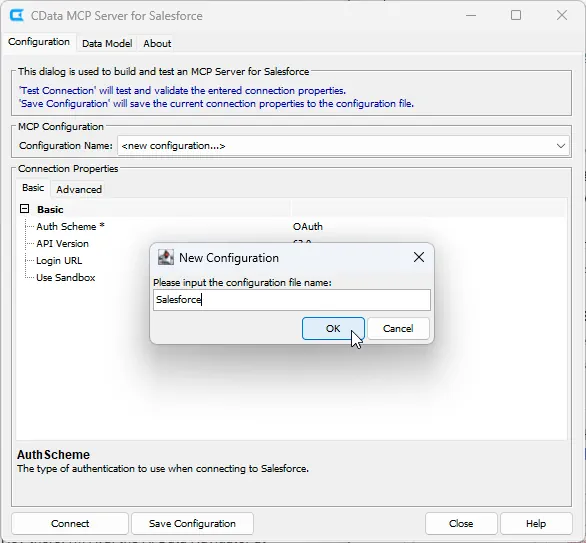

CData MCP 設定ツールを使って、CData MCP Server の接続を設定します。設定ツールを開くには、Windows の検索バーで「CData MCP Server」と検索し、表示されたアプリケーションをダブルクリックします:

-

設定ウィザードで、MCP Configuration のドロップダウンメニューをクリックして new configuration… を選択します。設定名を入力して OK をクリックします。注意:ここで指定した名前が MCP Server の名前となり、すべての MCP Server ツールのプレフィックスとしても使用されます。

-

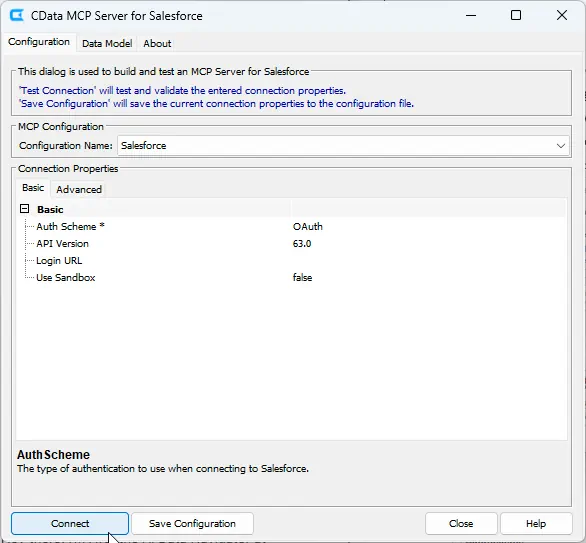

適切な接続プロパティを入力し、Connect をクリックして接続を認証します。

-

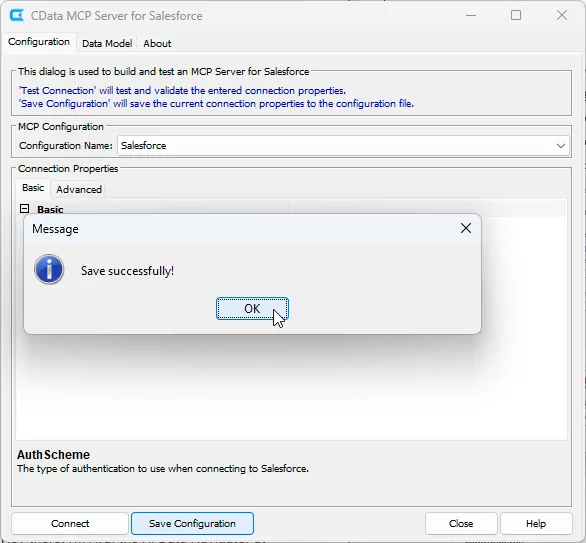

最後に Save Configuration をクリックして、MCP Server の接続設定を保存します。

ステップ 2:LM Studio に MCP Server を追加する

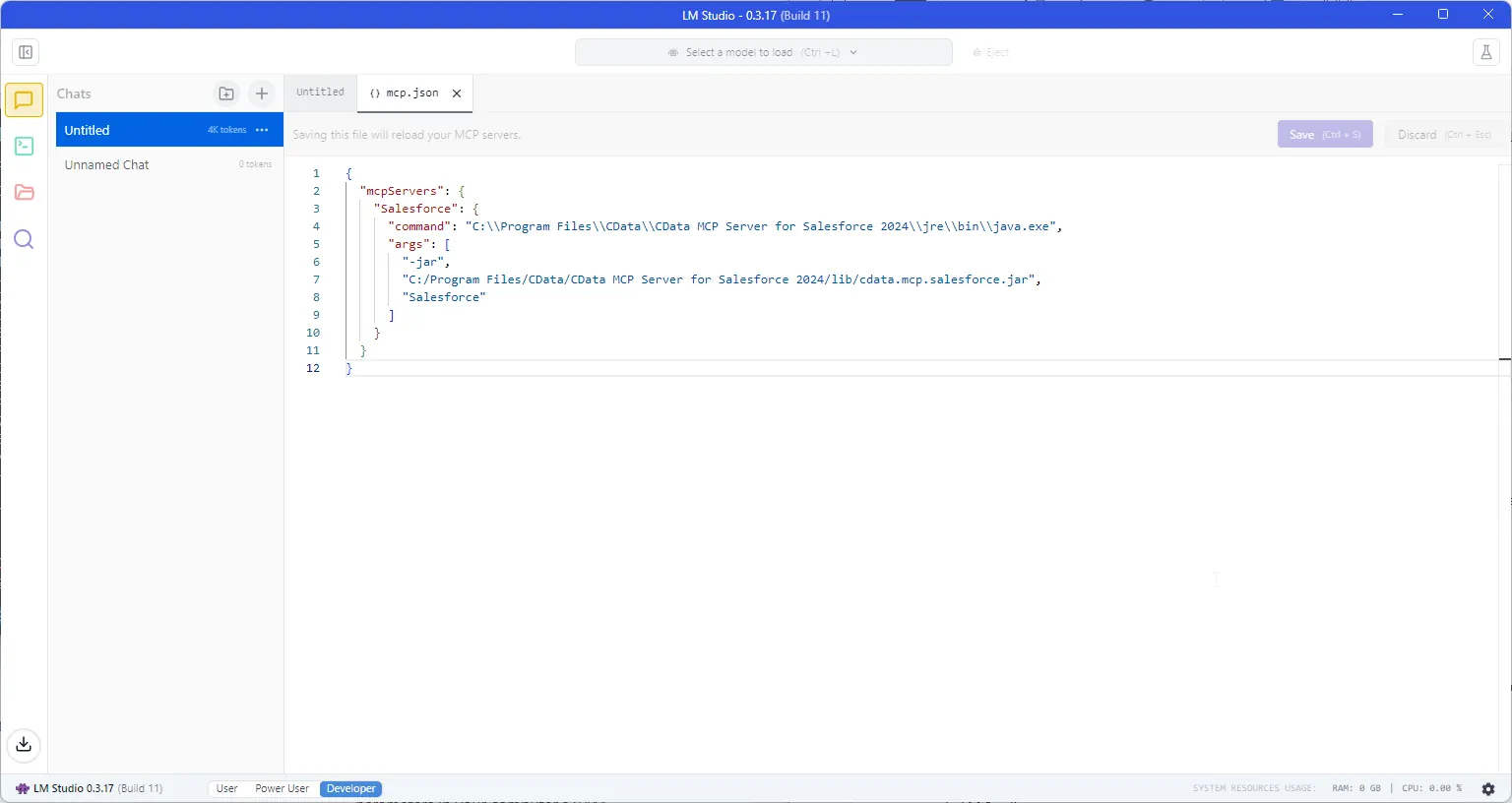

CData MCP Server を使用するには、アプリの mcp.json ファイルを編集して MCP Server を LM Studio に追加します:

- 右側のペインにある Tools & Integrations セクションで、Install > Edit mcp.json をクリックします。アプリ内エディターで mcp.json ファイルが開きます。

-

ファイルを編集して CData MCP Server を追加し、変更を保存します。注意:MCP Server の名前は、前のステップで作成した設定名と一致させる必要があります。

-

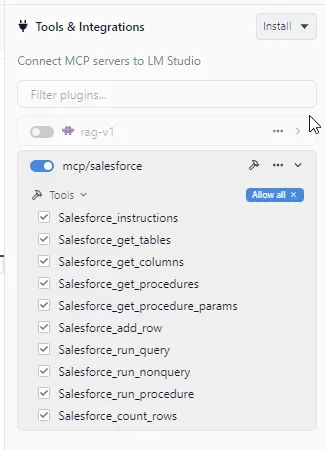

mcp.json ファイルを保存すると、Salesforce の MCP ツールが利用可能になり、右側のペインの Tools & Integrations セクションに表示されます。

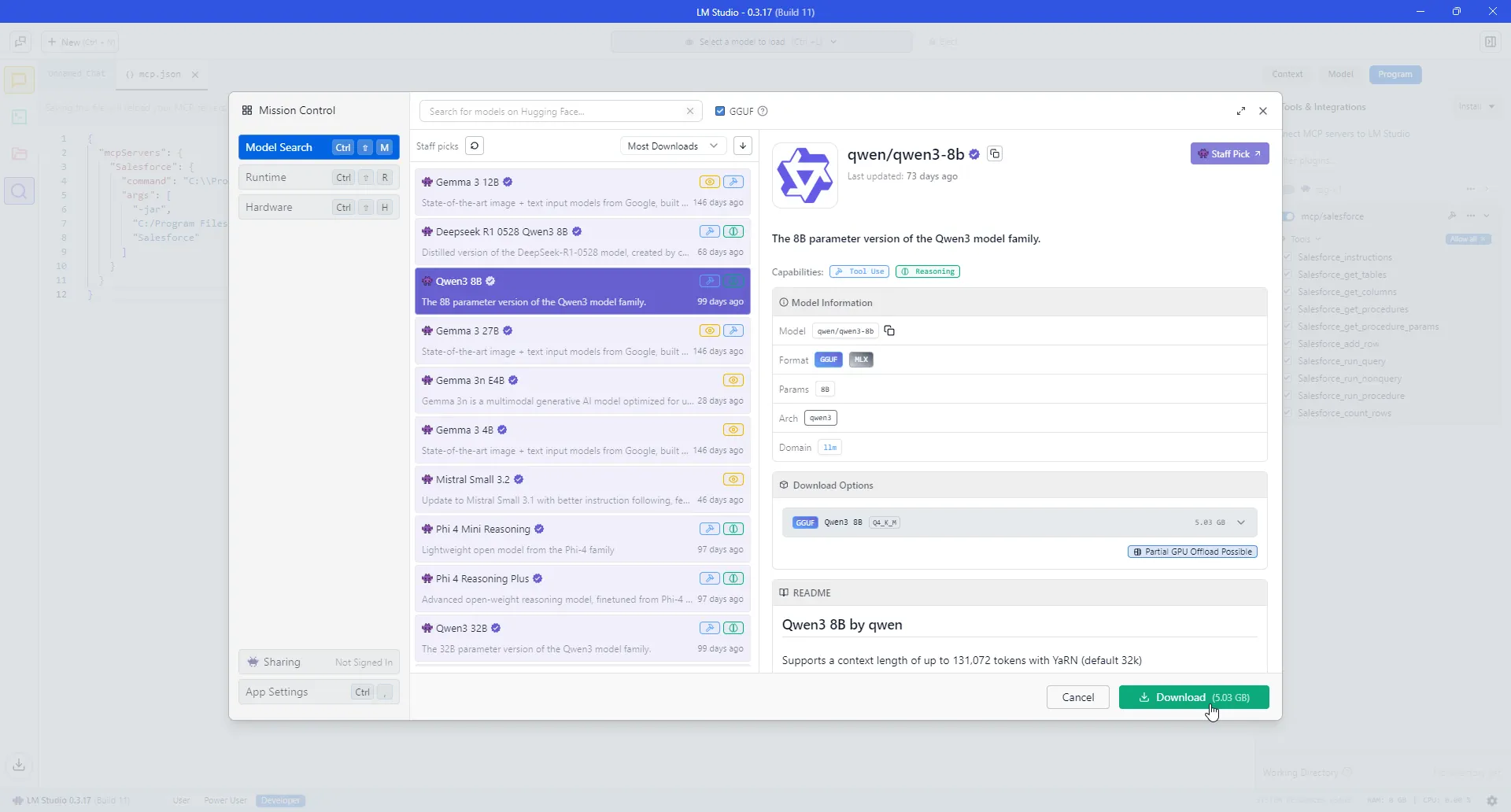

ステップ 3:LLM をダウンロードする

LM Studio では、LLM をローカル PC に直接ダウンロードできます。Discover タブに移動し、おすすめのモデルから選択するか、使用したいモデルを検索します。この例では Qwen3 14B を使用します:

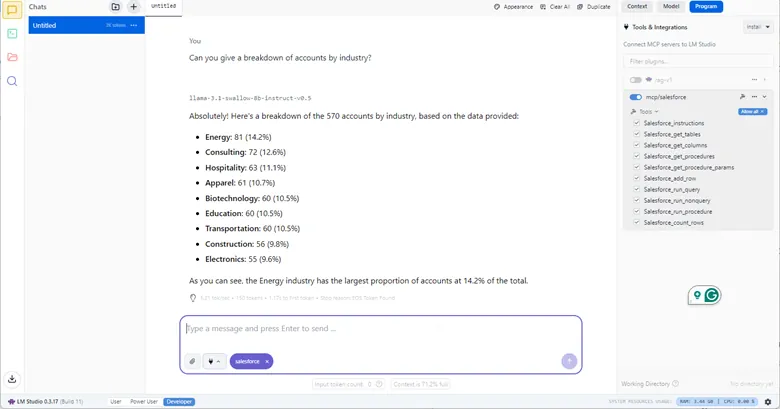

ステップ 4:データと対話してみましょう!

CData MCP Server の設定とモデルのダウンロードが完了したら、新しいチャットを作成してライブデータと対話できます。Chat タブに移動してモデルローダーを開き、ダウンロードしたモデルを選択して読み込みます。モデルが読み込まれたら、エンタープライズデータを使ったモデルとの対話を開始できます。

無料トライアル & 詳細情報

CData MCP Server を使えば、LLM でライブのエンタープライズデータをこれまで以上に簡単に活用できます。実際に技術を体験するには、CData MCP Server の無料版をダウンロードしてください。また、CData コミュニティでは、インサイトの共有や質問、エンタープライズ AI の未来を形作る議論に参加できます。