CData SSIS Components を使用して Sage Intacct のデータを Databricks にマイグレーション

Databricks は、大量のデータを簡単に処理、分析、可視化できる統合データ分析プラットフォームです。データエンジニアリング、データサイエンス、機械学習の機能を単一のプラットフォームに統合し、チームがコラボレーションしてデータからインサイトを得ることを容易にします。

CData SSIS Components は、SQL Server Integration Services を拡張し、さまざまなソースやデスティネーションからデータを簡単にインポート・エクスポートできるようにします。

この記事では、Databricks へのエクスポート時のデータ型マッピングの考慮事項を確認し、CData SSIS Components for Sage Intacct と Databricks を使用してSage Intacct のデータを Databricks にマイグレーションする方法を説明します。

データ型マッピング

| Databricks スキーマ | CData スキーマ |

|---|---|

|

int, integer, int32 |

int |

|

smallint, short, int16 |

smallint |

|

double, float, real |

float |

|

date |

date |

|

datetime, timestamp |

datetime |

|

time, timespan |

time |

|

string, varchar |

長さ > 4000 の場合:nvarchar(max)、それ以外:nvarchar(length) |

|

long, int64, bigint |

bigint |

|

boolean, bool |

tinyint |

|

decimal, numeric |

decimal |

|

uuid |

nvarchar(length) |

|

binary, varbinary, longvarbinary |

binary(1000) または SQL Server 2000 以降は varbinary(max) |

特別な考慮事項

- String/VARCHAR: Databricks の String カラムは、カラムの長さによって異なるデータ型にマッピングされます。カラムの長さが 4000 を超える場合、カラムは nvarchar(max) にマッピングされます。それ以外の場合は、nvarchar(length) にマッピングされます。

- DECIMAL: Databricks は最大 38 桁の精度の DECIMAL 型をサポートしていますが、それを超えるソースカラムはロードエラーを引き起こす可能性があります。

Sage Intacct データ連携について

CData は、Sage Intacct のライブデータにアクセスし、統合するための最も簡単な方法を提供します。お客様は CData の接続機能を以下の目的で使用しています:

- API の更新や変更を気にすることなく、Sage Intacct にアクセスできます。

- 追加の構成手順なしで、Sage Intacct のカスタムオブジェクトやフィールドにアクセスできます。

- Basic 認証による組み込み Web サービス認証情報を使用して、Sage Intacct にデータを書き戻すことができます。

- SQL ストアドプロシージャを使用して、ベンダーの承認・却下、エンゲージメントの挿入、カスタムオブジェクトやフィールドの作成・削除などの機能的な操作を実行できます。

ユーザーは、Tableau、Power BI、Excel などの分析ツールと Sage Intacct を統合し、当社のツールを活用して Sage Intacct データをデータベースやデータウェアハウスにレプリケートしています。

他のお客様が CData の Sage Intacct ソリューションをどのように使用しているかについては、ブログをご覧ください:Drivers in Focus: Accounting Connectivity

はじめに

前提条件

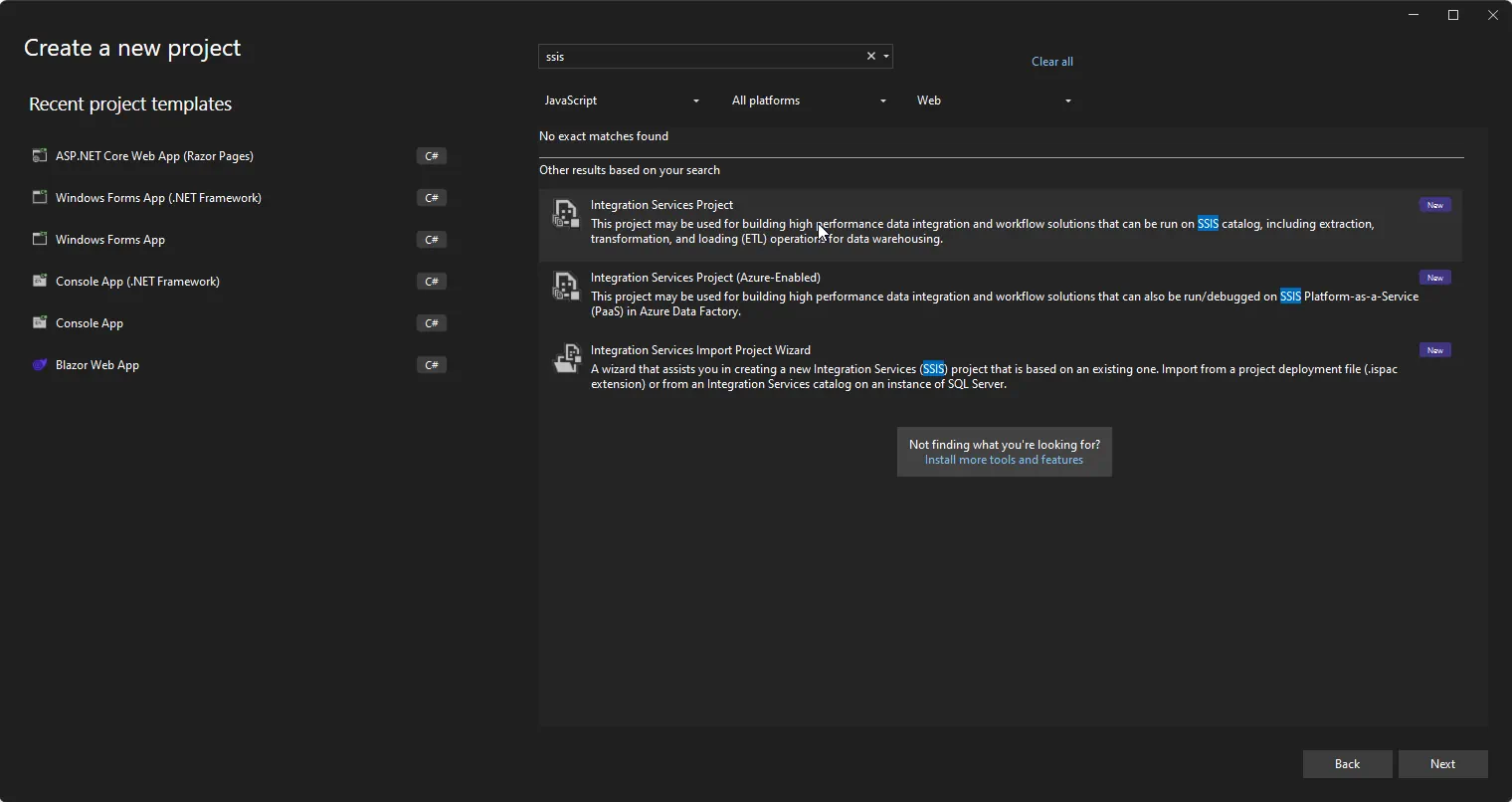

- Visual Studio 2022

- Visual Studio 2022 用 SQL Server Integration Services Projects 拡張機能

- CData SSIS Components for Databricks

- CData SSIS Components for Sage Intacct

プロジェクトの作成とコンポーネントの追加

-

Visual Studio を開き、新しい Integration Services プロジェクトを作成します。

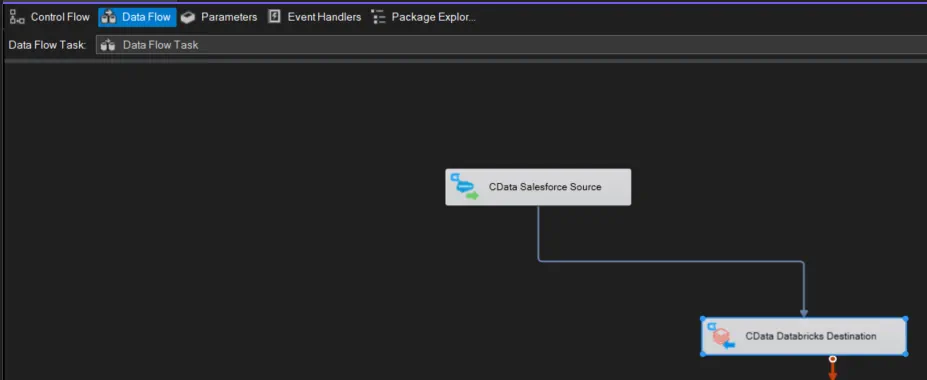

- Control Flow 画面に新しい Data Flow Task を追加し、Data Flow Task を開きます。

-

Data Flow Task に CData Sage Intacct Source コントロールと CData Databricks Destination コントロールを追加します。

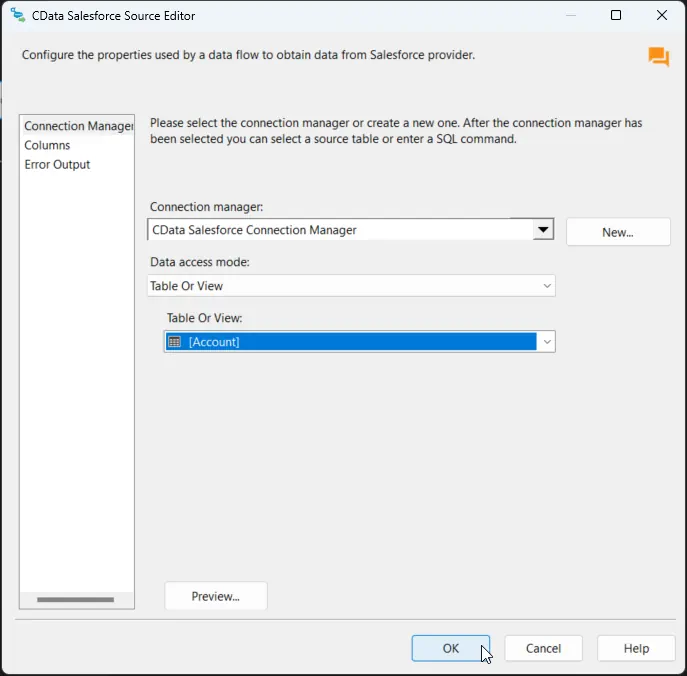

Sage Intacct ソースの設定

以下の手順に従って、Sage Intacct への接続に必要なプロパティを指定します。

-

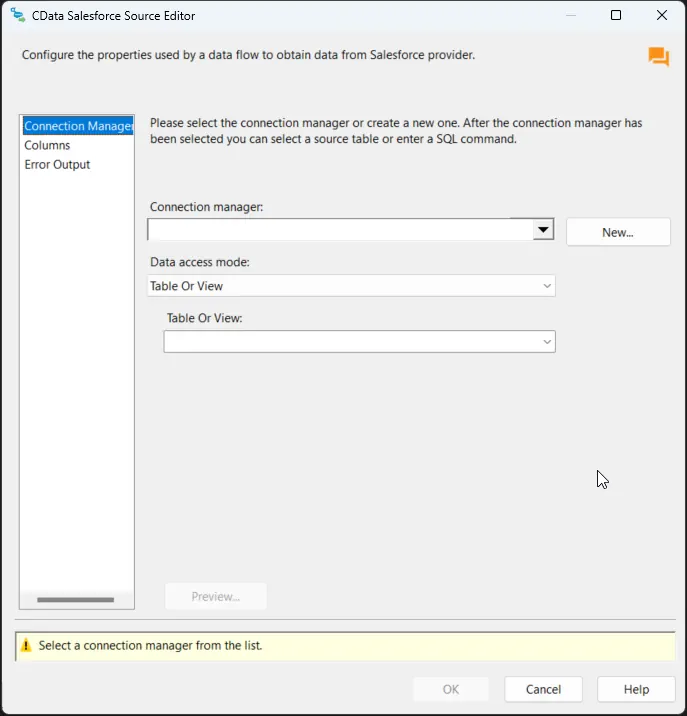

CData Sage Intacct Source をダブルクリックしてソースコンポーネントエディタを開き、新しい接続を追加します。

-

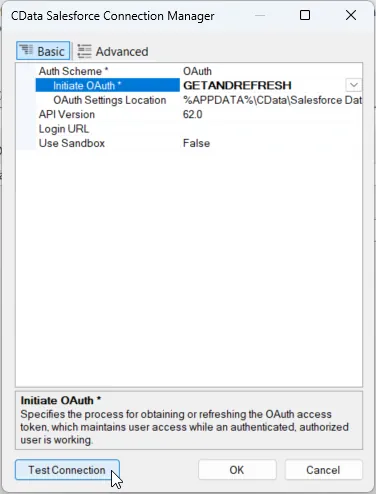

CData Sage Intacct Connection Manager で接続プロパティを設定し、接続をテストして保存します。

Sage Intacct 接続プロパティの取得・設定方法

独自のWeb サービスクレデンシャル、埋め込みクレデンシャル(Basic 認証)、またはOkta クレデンシャルのいずれかを使用して、Sage Intacct への接続を確立できます。

Sage Intacct への認証

Sage Intacct は2種類の認証をサポートします。Basic およびOkta です。選択した認証方法に関連するプロパティを設定して、接続を構成します。

Basic 認証

Basic 認証スキームでは、埋め込みクレデンシャルを使用してデータの読み書きが可能です。オプションとして、独自のWeb サービスクレデンシャルを指定することもできます。

Basic 認証を使用して認証を行うには、以下のプロパティを設定します。

- AuthScheme:Basic。

- CompanyID:Sage Intacct にログインする際に会社を識別するために使用するID。

- User:Sage Intacct へのログインに使用するログイン名。

- Password:ログインクレデンシャル用のパスワード。

- (オプション)SenderID およびSenderPassword:Web サービスのSender ID およびパスワード(独自のWeb サービスクレデンシャルを使用している場合のみ)。

独自のWeb サービスクレデンシャルではなく、埋め込みクレデンシャルを使用する場合は、以下を実行する必要があります:

- Web サービスダッシュボードで、会社 -> 会社情報 -> セキュリティタブに移動します。

- Web サービス認証に"CData" を追加します。これは大文字・小文字が区別されます。これを行うには、会社 -> 会社情報(新しいUI では、設定 -> 会社)-> セキュリティ -> Web サービス認証 / 編集に移動します。

-

接続を保存後、「Table or view」を選択し、Databricks にエクスポートするテーブルまたはビューを選択して、CData Sage Intacct Source Editor を閉じます。

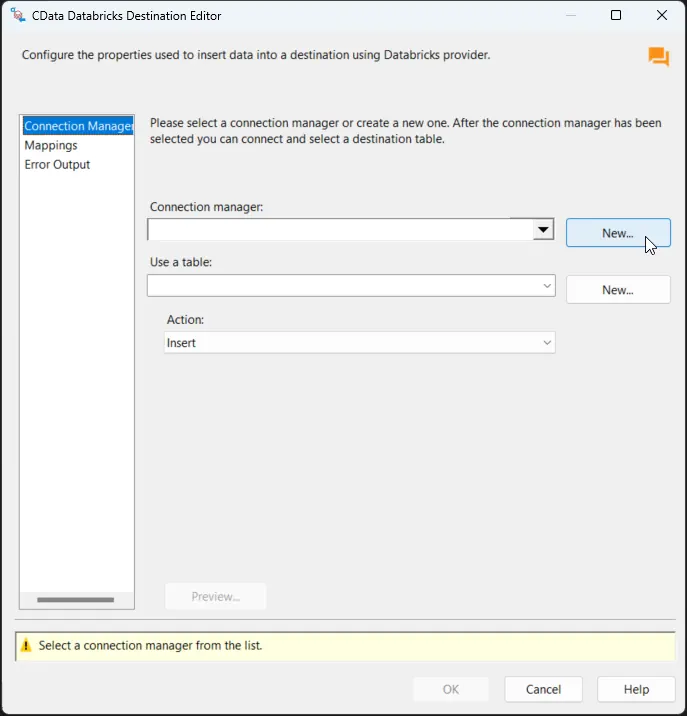

Databricks デスティネーションの設定

Sage Intacct Source を設定したら、Databricks 接続を設定してカラムをマッピングします。

-

CData Databricks Destination をダブルクリックしてデスティネーションコンポーネントエディタを開き、新しい接続を追加します。

-

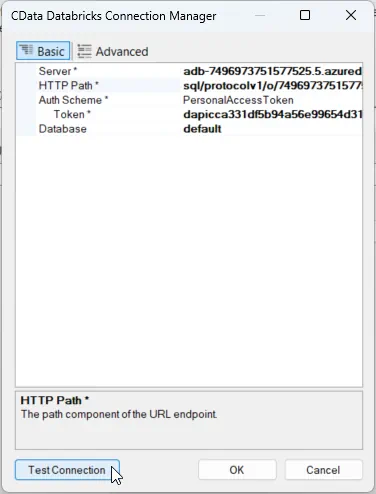

CData Databricks Connection Manager で接続プロパティを設定し、接続をテストして保存します。Databricks クラスターに接続するには、以下のようにプロパティを設定します。

注意:必要な値は、Databricks インスタンスで Clusters に移動し、目的のクラスターを選択して、Advanced Options の下にある JDBC/ODBC タブを選択することで確認できます。

- Server:Databricks クラスターの Server Hostname を設定します。

- HTTPPath:Databricks クラスターの HTTP Path を設定します。

- Token:個人用アクセストークンを設定します(この値は、Databricks インスタンスの User Settings ページに移動し、Access Tokens タブを選択することで取得できます)。

その他の便利な接続プロパティ

- QueryPassthrough: True に設定すると、クエリは Databricks に直接渡されます。

- ConvertDateTimetoGMT: True に設定すると、コンポーネントはローカルマシンの時刻ではなく、日時値を GMT に変換します。

- UseUploadApi: このプロパティを true に設定すると、Bulk INSERT 操作で大量のデータがある場合にパフォーマンスが向上します。

- UseCloudFetch: このオプションは、テーブルに 100 万件を超えるエントリがある場合にクエリ効率を向上させるために CloudFetch を使用するかどうかを指定します。

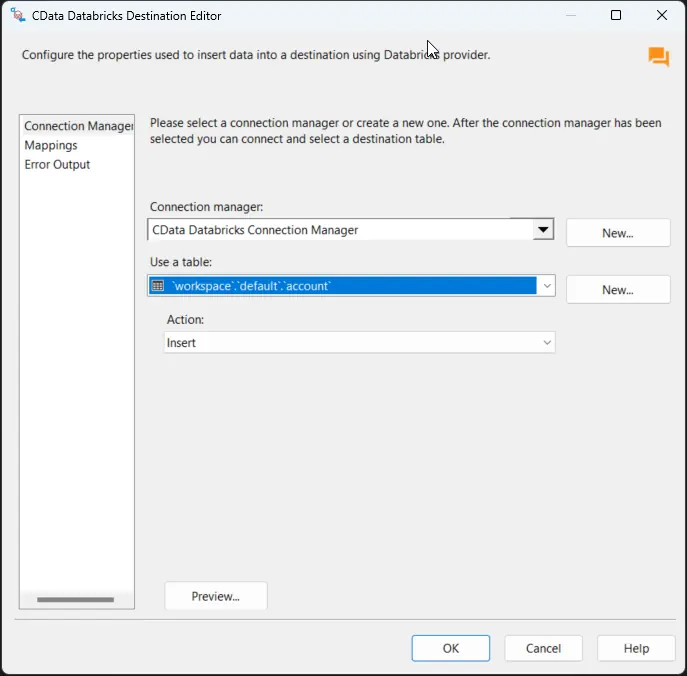

-

接続を保存後、Use a Table メニューでテーブルを選択し、Action メニューで Insert を選択します。

-

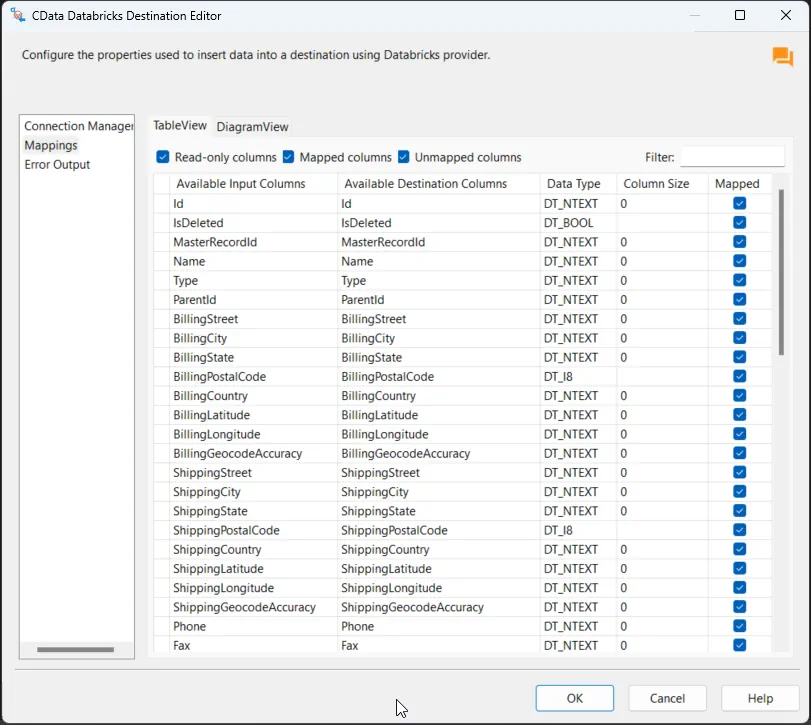

Column Mappings タブで、入力カラムからデスティネーションカラムへのマッピングを設定します。

プロジェクトの実行

これでプロジェクトを実行できます。SSIS Task の実行が完了すると、SQL テーブルのデータが選択したテーブルにエクスポートされます。