Azure Databricks でSage 300 のデータに接続してデータ処理を行う方法

Databricks は、Apache Spark によるデータ処理機能を提供するクラウドベースのサービスです。CData JDBC ドライバと組み合わせることで、Databricks を使用してリアルタイムSage 300 のデータのデータエンジニアリングとデータサイエンスを実行できます。この記事では、Azure で CData JDBC ドライバをホストし、Databricks からリアルタイムSage 300 のデータに接続してデータを処理する方法を説明します。

最適化されたデータ処理機能を組み込んだ CData JDBC ドライバは、リアルタイムSage 300 のデータとのインタラクションにおいて卓越したパフォーマンスを発揮します。Sage 300 に対して複雑な SQL クエリを発行すると、ドライバーはフィルタや集計などのサポートされている SQL 操作を直接Sage 300にプッシュし、サポートされていない操作(主に SQL 関数や JOIN 操作)は組み込みの SQL エンジンを使用してクライアント側で処理します。動的メタデータクエリ機能により、ネイティブのデータ型を使用してSage 300 のデータの操作・分析が可能です。

CData JDBC ドライバを Azure にインストール

Databricks でリアルタイムSage 300 のデータを操作するには、Azure Data Lake Storage(ADLS)を通じてドライバーをインストールします。(以前のバージョンの記事で説明していた DBFS を介した接続方法は非推奨となっていますが、廃止日は公開されていません。)

- JDBC JAR ファイルを任意の Blob コンテナにアップロードします(例:「databrickslibraries」ストレージアカウントの「jdbcjars」コンテナ)。

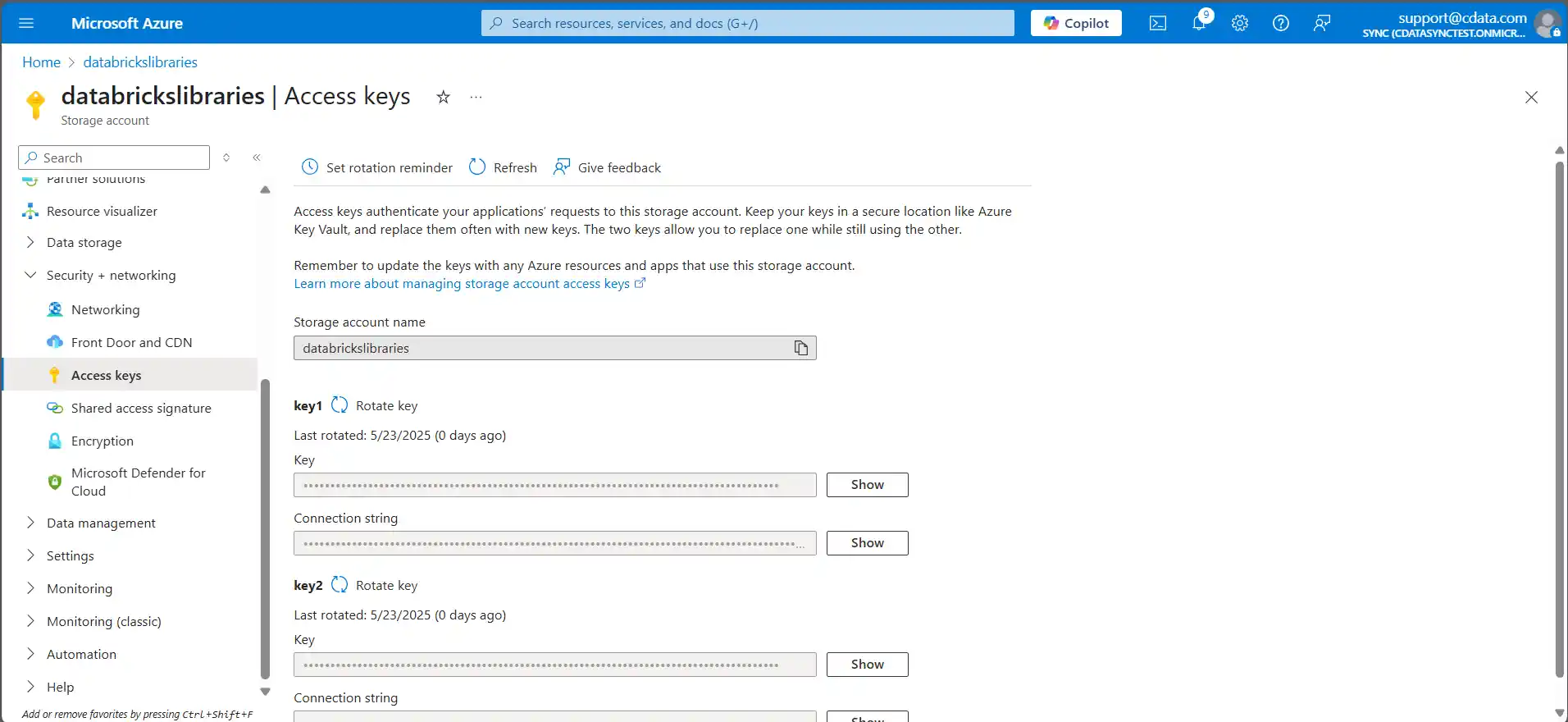

- ストレージアカウントから「セキュリティとネットワーク」を展開し、「アクセスキー」をクリックしてアカウントキーを取得します。使用するキーを表示してコピーしてください。

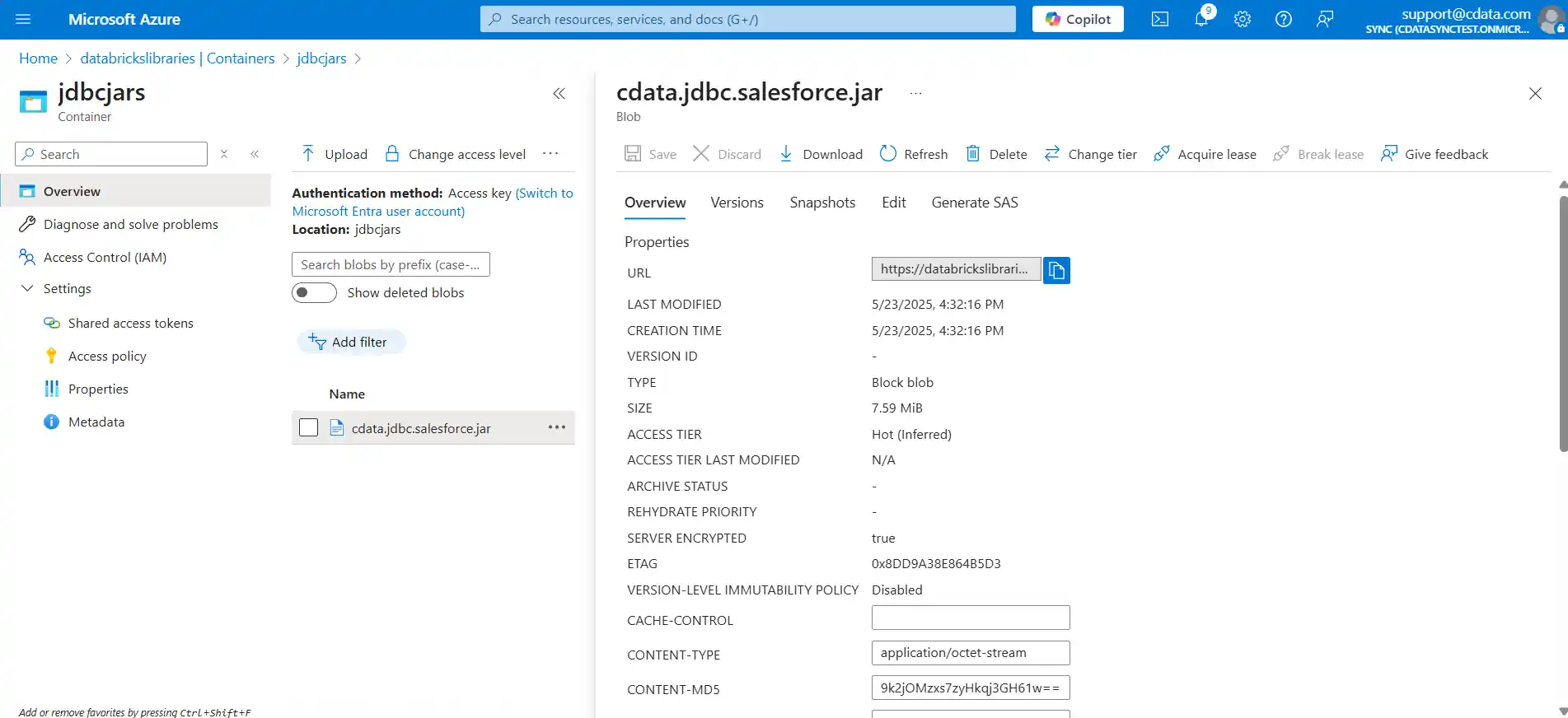

- コンテナに移動し、JAR を保存している特定のコンテナを開き、JDBC JAR ファイルのエントリを選択して JAR ファイルの URL を取得します。ファイルの詳細が開き、URL をクリップボードにコピーするボタンがあります。この値は以下のようになります(「blob」の部分はストレージアカウントの種類によって異なる場合があります):

https://databrickslibraries.blob.core.windows.net/jdbcjars/cdata.jdbc.salesforce.jar

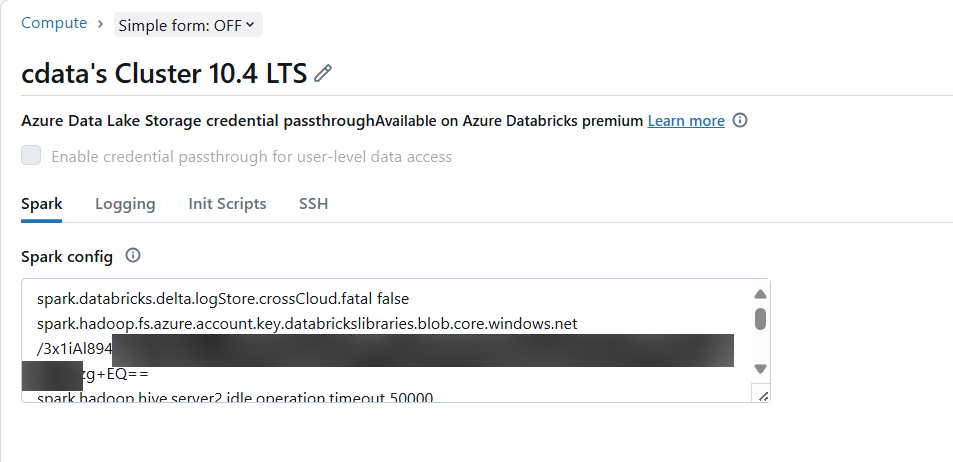

- Databricks クラスターの「Configuration」タブで「Edit」ボタンをクリックし、「Advanced options」を展開します。そこで、以下の Spark オプション(JAR URL のドメイン名から派生)に、コピーしたアカウントキーを値として追加し、「Confirm」をクリックします:

spark.hadoop.fs.azure.account.key.databrickslibraries.blob.core.windows.net

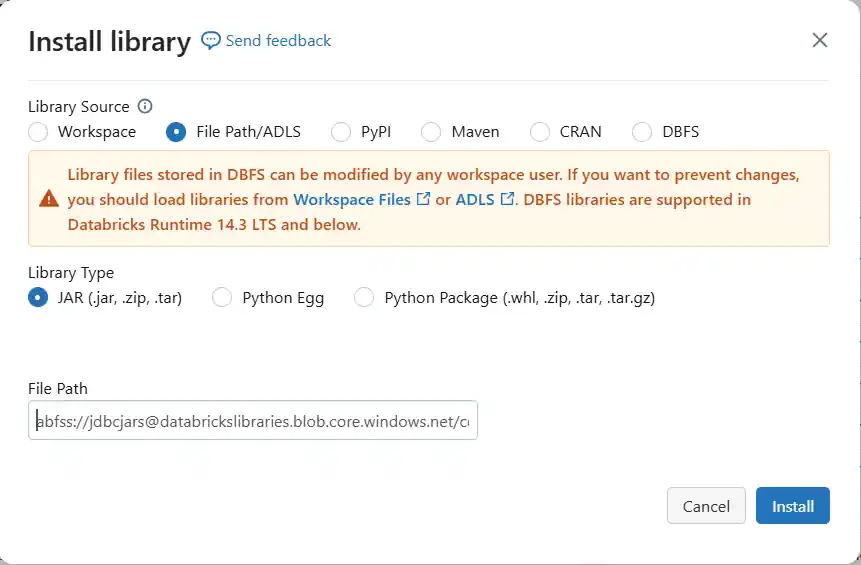

- Databricks クラスターの「Libraries」タブで「Install new」をクリックし、ADLS オプションを選択します。ドライバー JAR の ABFSS URL(これも JAR URL のドメイン名から派生)を指定し、「Install」をクリックします。ABFSS URL は以下のようになります:

abfss://[email protected]/cdata.jdbc.salesforce.jar

Databricks からSage 300に接続

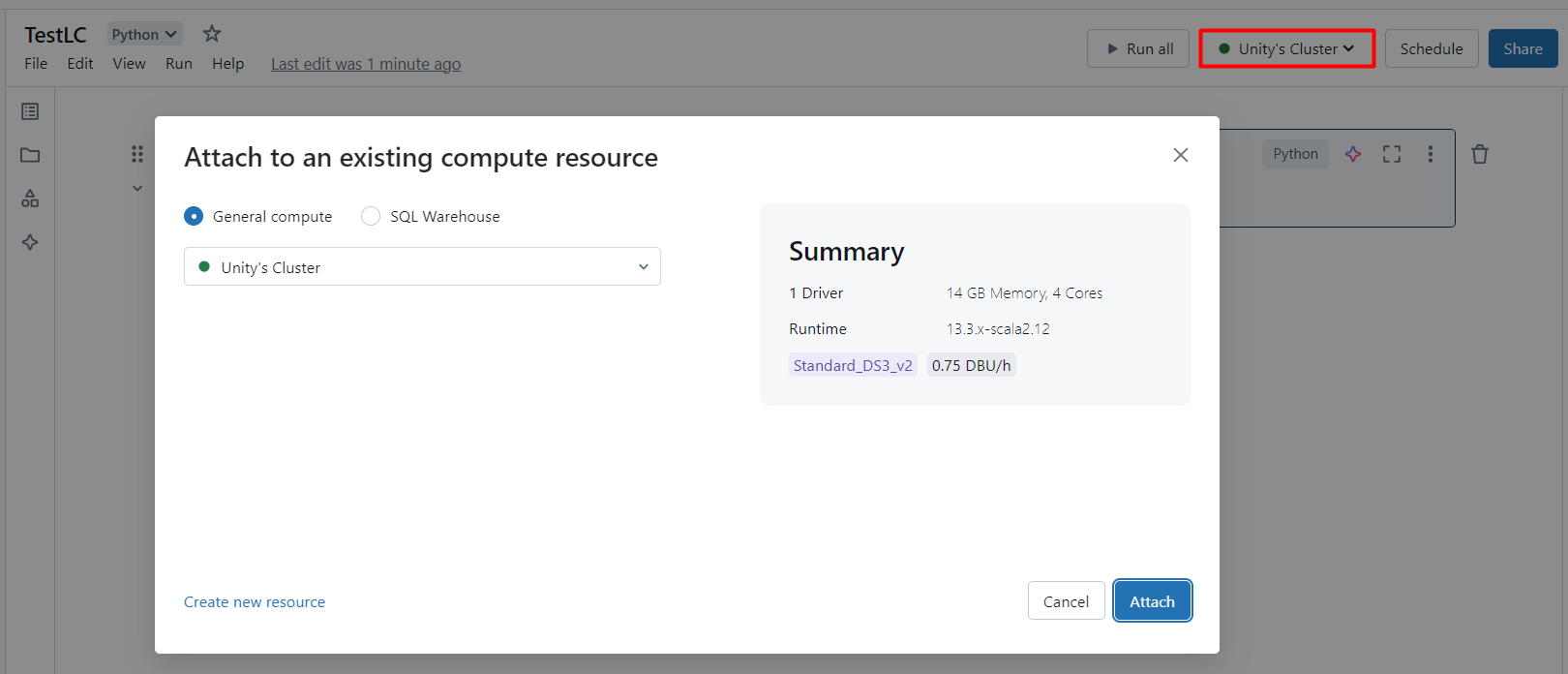

JAR ファイルがインストールされたら、Databricks でリアルタイムSage 300 のデータを操作する準備が整いました。まず、ワークスペースで新しいノートブックを作成します。ワークブックに名前を付け、言語として Python が選択されていることを確認し(デフォルトで選択されているはずです)、「Connect」をクリックして「General Compute」から JDBC ドライバーをインストールしたクラスターを選択します(デフォルトで選択されているはずです)。

Sage 300への接続を設定

JDBC ドライバのクラスを参照し、JDBC URL で使用する接続文字列を構築してSage 300に接続します。また、JDBC URL に RTK プロパティを設定する必要があります(Beta ドライバーを使用している場合を除く)。このプロパティの設定方法については、インストールに含まれるライセンスファイルを参照してください。

driver = "cdata.jdbc.sage300.Sage300Driver" url = "jdbc:sage300:RTK=5246...;User=SAMPLE;Password=password;URL=http://127.0.0.1/Sage300WebApi/v1/-/;Company=SAMINC;"

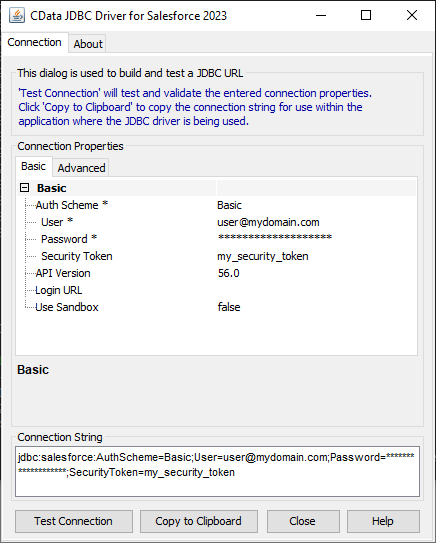

組み込みの接続文字列デザイナー

JDBC URL の構築には、Sage 300 JDBC Driver に組み込まれている接続文字列デザイナーを使用できます。JAR ファイルをダブルクリックするか、コマンドラインから JAR ファイルを実行してください。

java -jar cdata.jdbc.sage300.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Sage 300 には、Sage 300 Web API で通信するための初期設定が必要となるます。

- Sage 300 のユーザー向けのセキュリティグループを設定します。Sage 300 のユーザーに、Security Groups の下にあるbSage 300 Web API オプションへのアクセスを付与します(各モジュール毎に必要です)。

- /Online/Web と/Online/WebApi フォルダ内のweb.config ファイルを両方編集して、AllowWebApiAccessForAdmin のキーを true 設定します。webAPI アプリプールを再起動すると設定が反映されます。

- ユーザーアクセスを設定したら、https://server/Sage300WebApi/ をクリックして、web API へのアクセスを確認してください。

Basic 認証を使用してSage 300 へ認証します。

Basic 認証を使用して接続する

Sage 300 に認証するには、次のプロパティを入力してください。プロバイダーは、クッキーを使用してSage 300 が開いたセッションを再利用することに注意してください。 そのため、資格情報はセッションを開く最初のリクエストでのみ使用されます。その後は、Sage 300 が返すクッキーを認証に使用します。

- Url:Sage 300 をホストするサーバーのURL に設定します。Sage 300 Web API 用のURL を次のように作成してください。 {protocol}://{host-application-path}/v{version}/{tenant}/ 例えば、 http://localhost/Sage300WebApi/v1.0/-/ です。

- User:アカウントのユーザー名に設定します。

- Password:アカウントのパスワードに設定します。

Sage 300 のデータの読み込み

接続を設定したら、CData JDBC ドライバと接続情報を使用してSage 300 のデータをデータフレームとして読み込むことができます。

remote_table = spark.read.format ( "jdbc" ) \ .option ( "driver" , driver) \ .option ( "url" , url) \ .option ( "dbtable" , "OEInvoices") \ .load ()

Sage 300 のデータの表示

読み込んだSage 300 のデータを display 関数で確認してみましょう。

display (remote_table.select ("InvoiceUniquifier"))

Azure Databricks でSage 300 のデータを分析

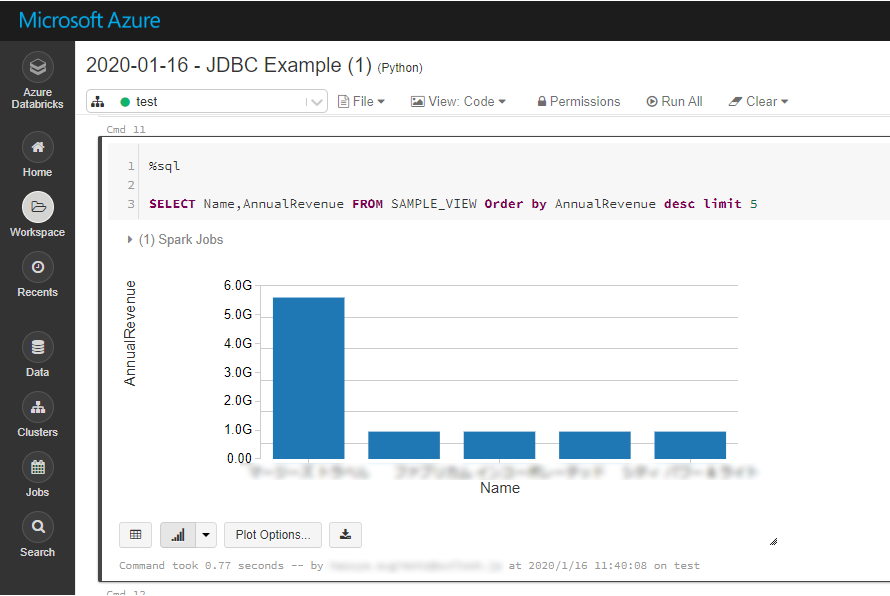

Databricks SparkSQL でデータを処理したい場合は、読み込んだデータを一時ビューとして登録します。

remote_table.createOrReplaceTempView ( "SAMPLE_VIEW" )

以下の SparkSQL で分析用のSage 300 のデータを取得できます。

result = spark.sql("SELECT InvoiceUniquifier, ApprovedLimit FROM SAMPLE_VIEW WHERE AllowPartialShipments = 'Yes'")

Sage 300 からのデータは、対象のノートブック内でのみ利用可能です。他のユーザーと共有したい場合は、テーブルとして保存してください。

remote_table.write.format ( "parquet" ) .saveAsTable ( "SAMPLE_TABLE" )

CData JDBC Driver for Sage 300 の30日間の無償トライアルをダウンロードして、Azure Databricks でリアルタイムSage 300 のデータを活用してみてください。ご不明な点があれば、サポートチームまでお気軽にお問い合わせください。