GitHub Copilot × CData Code Assist MCP for Apache Spark で Spark のリアルタイムデータを活用する方法

GitHub Copilot は、Visual Studio Code をはじめとする IDE に統合された AI コーディングアシスタントです。MCP に対応しているため、ローカルツールやエンタープライズデータソースに接続し、開発中にリアルタイムデータを自然言語で操作できます。

Model Context Protocol(MCP) は、LLM クライアントを外部サービスに接続するためのオープンスタンダードです。MCP サーバーはスキーマの探索やリアルタイムクエリなどの機能を提供し、AI エージェントがリアルタイムデータに安全かつ一貫した方法でアクセスできるようにします。

この記事では、CData Code Assist MCP for Apache Spark のインストールから Spark への接続設定、Code Assist MCP アドオンと GitHub Copilot の連携、さらに Visual Studio Code から Spark のデータ をクエリする方法まで、ステップバイステップで解説します。

前提条件

- Visual Studio Code がインストールされていること

- Visual Studio Code で GitHub Copilot Chat 拡張機能が有効になっていること

- CData Code Assist MCP for Apache Spark がインストールされていること

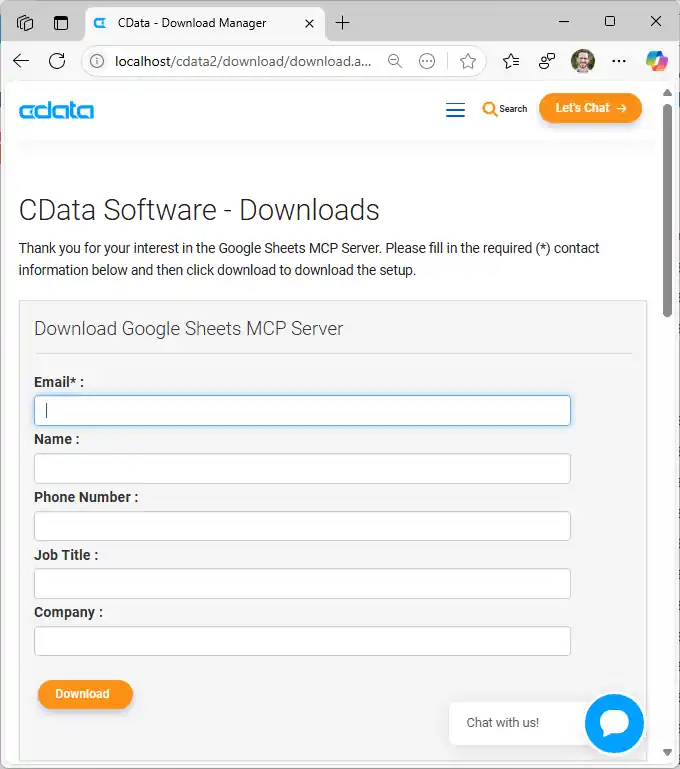

ステップ1:CData Code Assist MCP for Apache Spark のダウンロードとインストール

- まずは CData Code Assist MCP for Apache Spark をダウンロードします。

- ダウンロードしたインストーラーをダブルクリックして実行します。

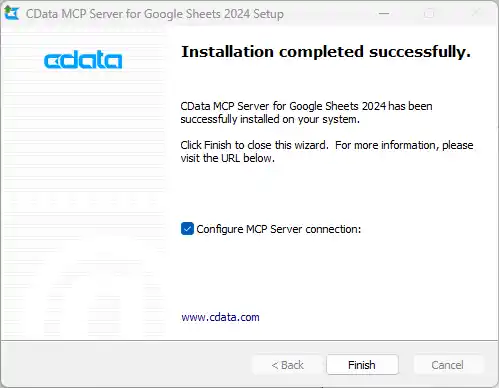

- 画面の指示に従ってインストールを完了させます。

インストールが完了したら、Spark への接続設定に進みましょう。

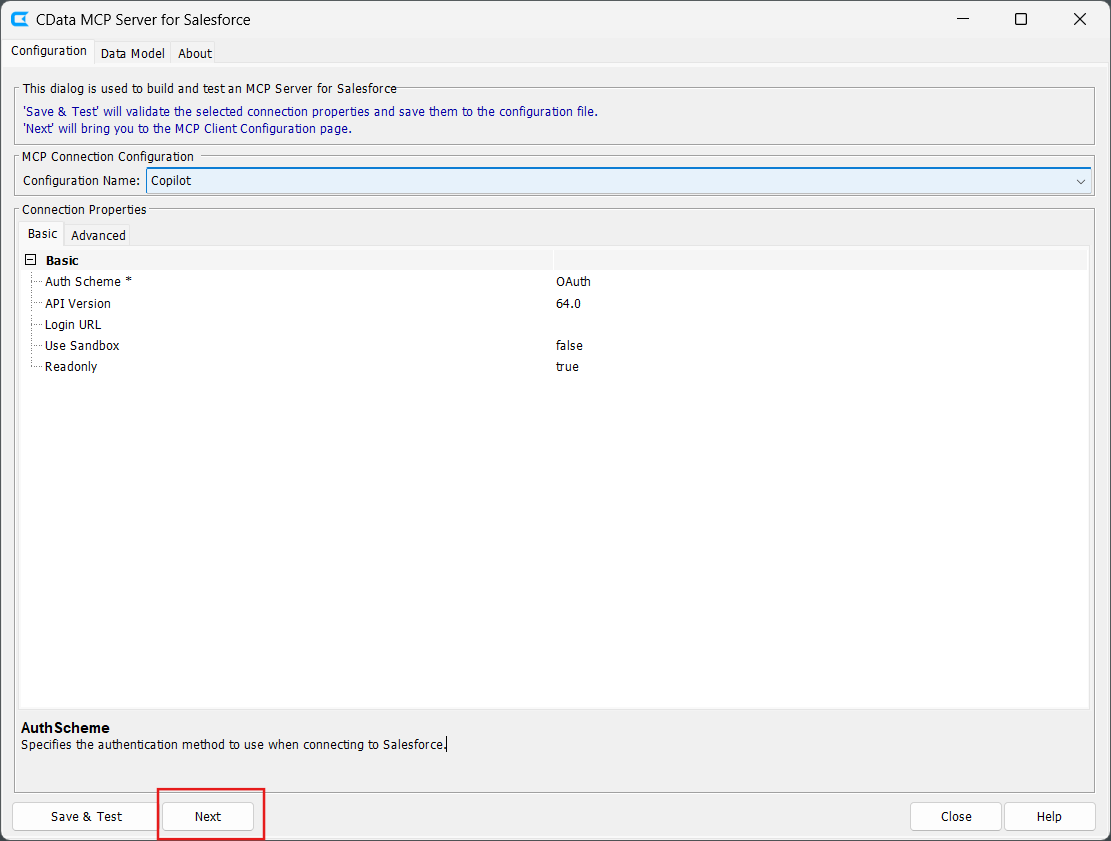

ステップ2:Spark への接続を設定

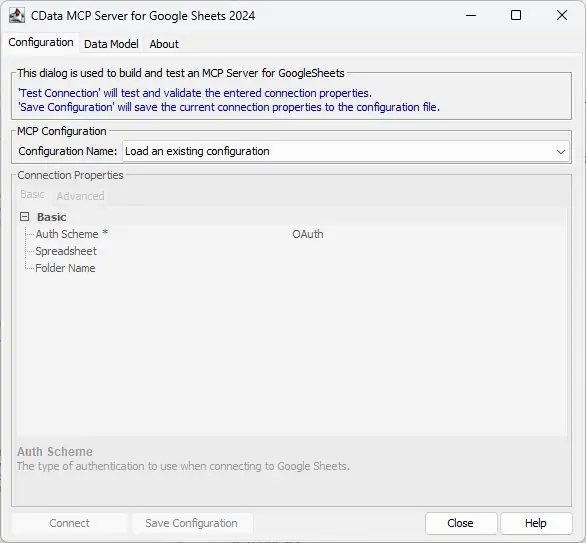

- インストールが完了すると、CData Code Assist MCP for Apache Spark の設定ウィザードが起動します。

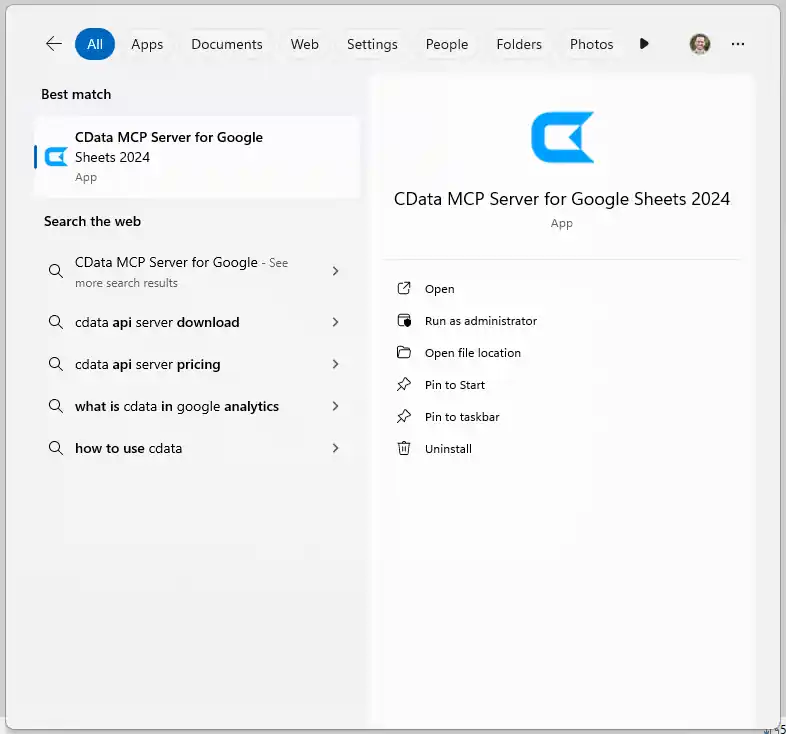

注意:ウィザードが自動的に起動しない場合は、Windows の検索バーで「CData Code Assist MCP for Apache Spark」と入力し、アプリケーションを起動してください。

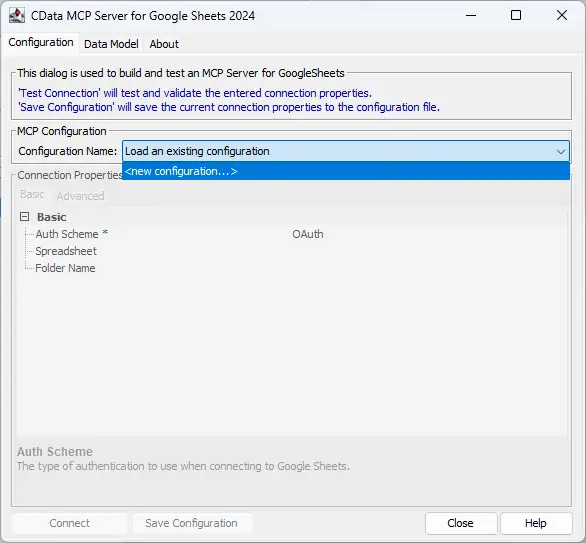

- MCP Configuration > Configuration Name で、既存の構成を選択するか、

を選択して新しい構成を作成します。

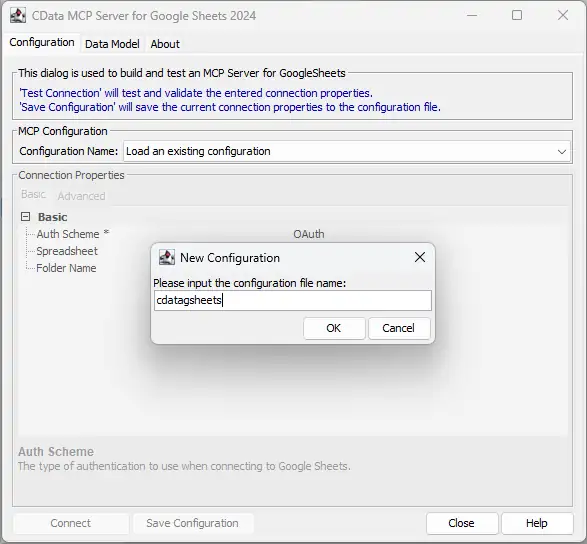

- 構成名を入力(例:「cdata_sparksql」)し、OK をクリックします。

-

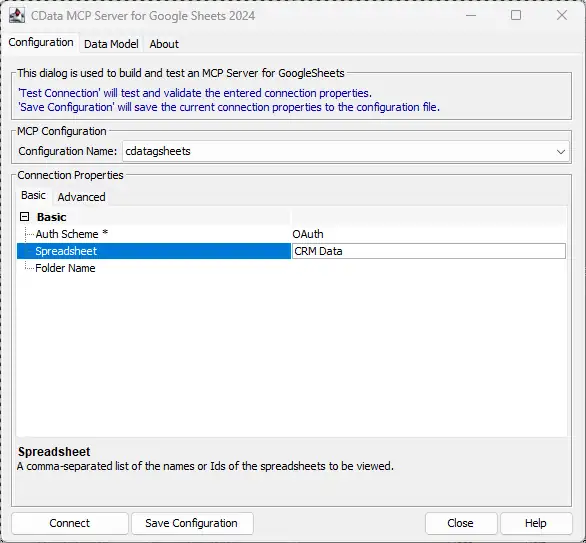

設定ウィザードで適切な接続プロパティを入力します。

SparkSQL への接続

SparkSQL への接続を確立するには以下を指定します。

- Server:SparkSQL をホストするサーバーのホスト名またはIP アドレスに設定。

- Port:SparkSQL インスタンスへの接続用のポートに設定。

- TransportMode:SparkSQL サーバーとの通信に使用するトランスポートモード。有効な入力値は、BINARY およびHTTP です。デフォルトではBINARY が選択されます。

- AuthScheme:使用される認証スキーム。有効な入力値はPLAIN、LDAP、NOSASL、およびKERBEROS です。デフォルトではPLAIN が選択されます。

Databricks への接続

Databricks クラスターに接続するには、以下の説明に従ってプロパティを設定します。Note:必要な値は、「クラスター」に移動して目的のクラスターを選択し、 「Advanced Options」の下にある「JDBC/ODBC」タブを選択することで、Databricks インスタンスで見つけることができます。

- Server:Databricks クラスターのサーバーのホスト名に設定。

- Port:443

- TransportMode:HTTP

- HTTPPath:Databricks クラスターのHTTP パスに設定。

- UseSSL:True

- AuthScheme:PLAIN

- User:'token' に設定。

- Password:パーソナルアクセストークンに設定(値は、Databricks インスタンスの「ユーザー設定」ページに移動して「アクセストークン」タブを選択することで取得できます)。

- Connect をクリックして、Spark に認証します。

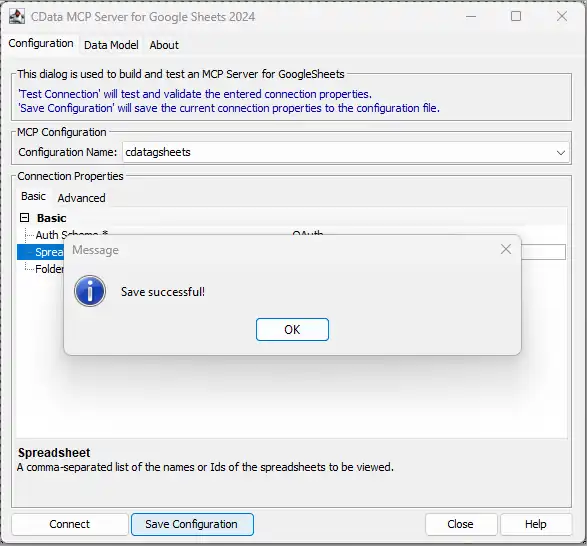

- Save & Test をクリックして接続を確定します。

この操作により、GitHub Copilot が Code Assist MCP アドオンを起動する際に参照する .mcp 構成ファイルが作成されます。続いて、Code Assist MCP アドオンを GitHub Copilot に接続しましょう。

ステップ3:Code Assist MCP アドオンを GitHub Copilot に接続

- Visual Studio Code をダウンロード・インストールし、GitHub Copilot Chat 拡張機能を有効にします。

- mcp.json ファイルを開くか新規作成します。

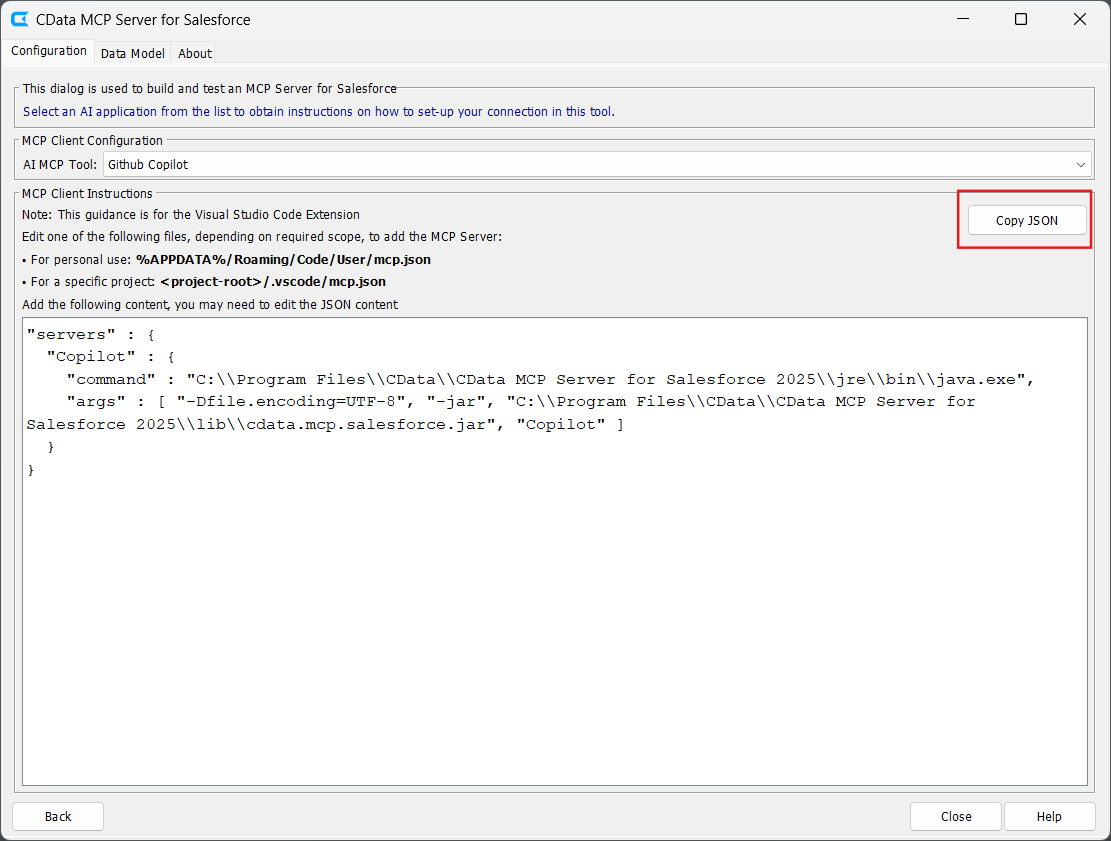

- グローバル設定の場合:%%APPDATA%%/Roaming/Code/User/mcp.json

- プロジェクト固有の設定の場合:

/.vscode/mcp.json

- 以下の JSON コードを追加してファイルを保存します。

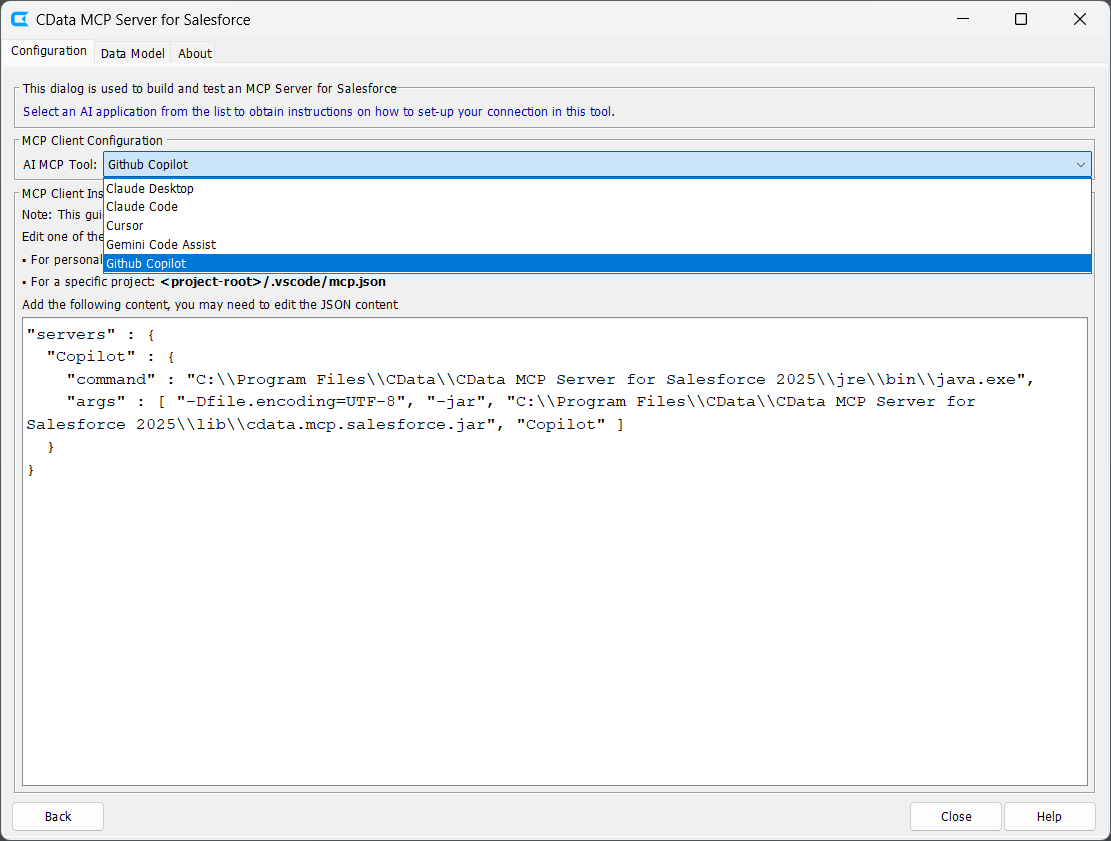

- 設定ウィザードで接続の保存とテストが完了したら、Next をクリックします。

- AI MCP Tool ドロップダウンから Github Copilot を選択します。

- MCP Client Instructions に従って、必要な構成ファイルを作成します。

- 表示された JSON コードをコピーして、構成ファイルに貼り付けます。

方法1:MCP 構成を手動で追加する

{

"servers": {

"cdata_sparksql": {

"command": "C:\Program Files\CData\CData Code Assist MCP for Apache Spark\jre\bin\java.exe",

"args": [

"-Dfile.encoding=UTF-8",

"-jar",

"C:\Program Files\CData\CData Code Assist MCP for Apache Spark\lib\cdata.mcp.sparksql.jar",

"cdata_sparksql"

]

}

}

}

注意:command の値には Java 17+ の java.exe 実行ファイルへのパスを、JAR パスには CData Code Assist MCP アドオンの .jar ファイルへのパスを指定してください。最後の引数は、CData 設定ウィザードで保存した MCP 構成名(例:「cdata_sparksql」)と一致させる必要があります。

方法2:CData Code Assist MCP for Apache Spark の UI から MCP 構成をコピーする

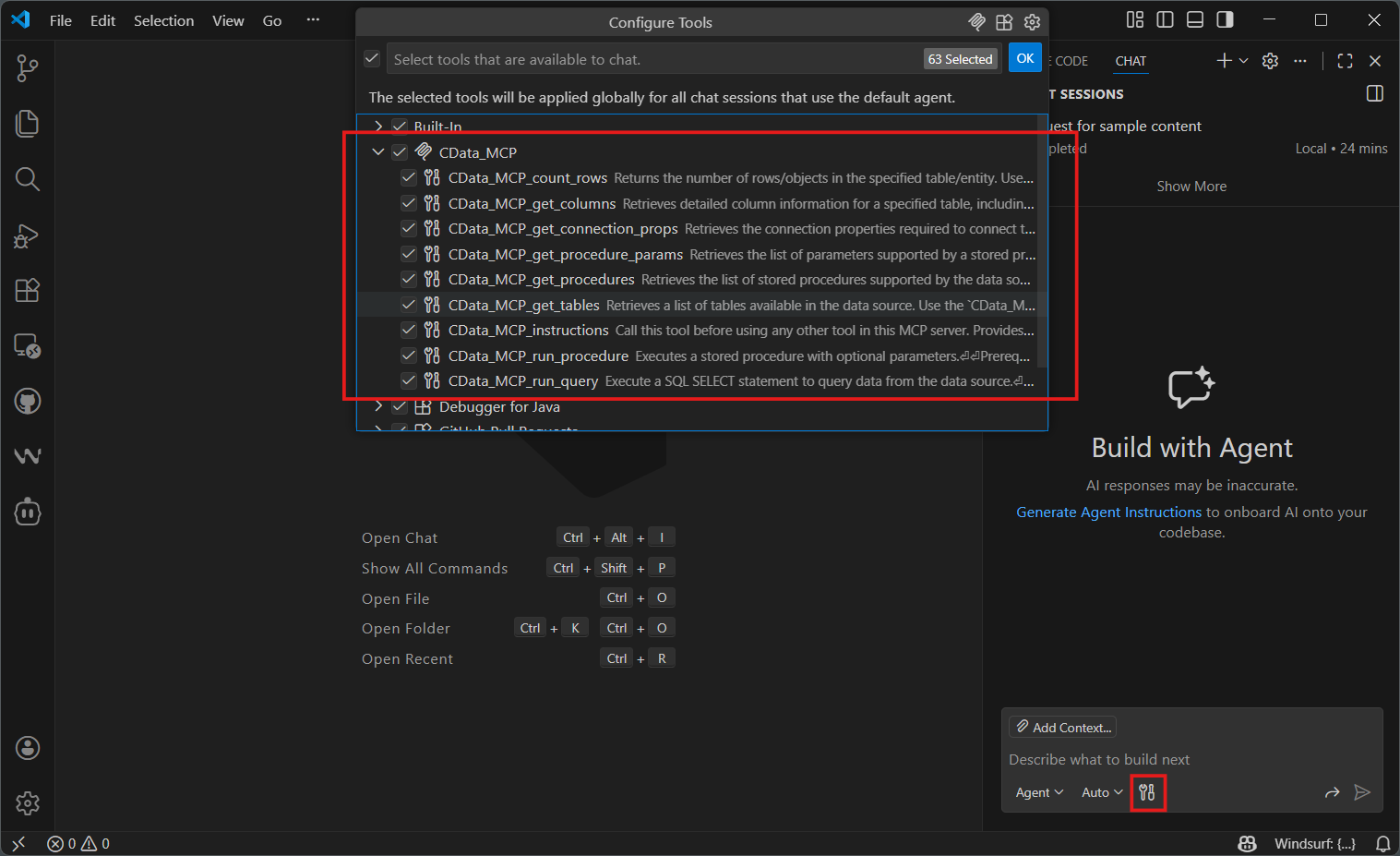

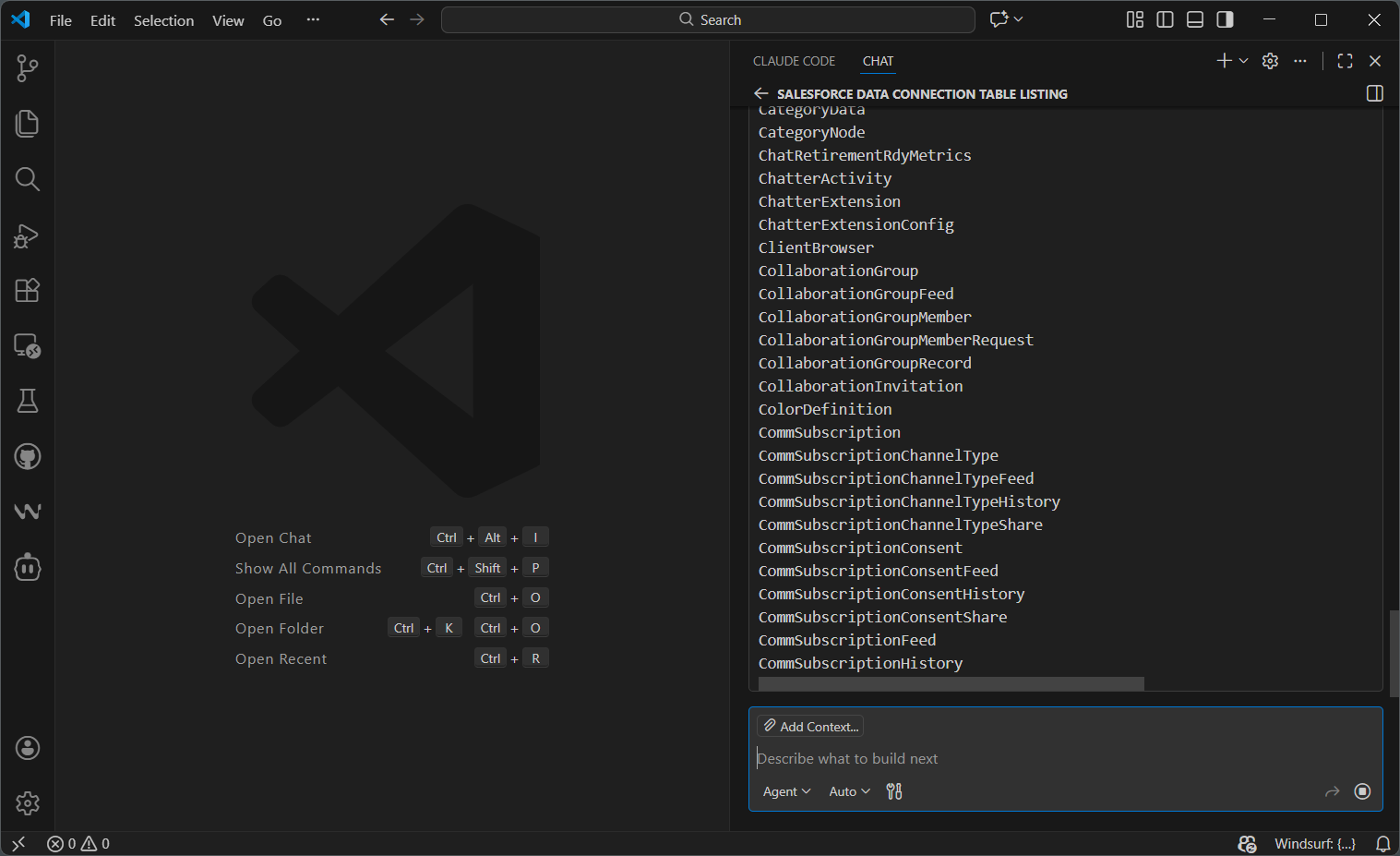

ステップ4:GitHub Copilot からリアルタイム Spark のデータ をクエリ

- Visual Studio Code を起動し、GitHub Copilot Chat インターフェースを開きます。ツールアイコンを選択して、設定済みの Code Assist MCP アドオンを有効にします。

- 自然言語で Spark のデータ について質問してみましょう。例:

"List all tables available in my Spark のデータ data connection."

- 自然言語プロンプトを使って開発を進めることもできます:

For my project, data from the Customers is very important. Pull data from the most important columns like City and Balance.

これで GitHub Copilot と CData Code Assist MCP for Apache Spark の連携は完了です。MCP ツールを使用して、スキーマの探索や Spark に対するリアルタイムクエリを実行できます。

Code Assist MCP で構築。CData Drivers で本番運用。

Code Assist MCP を無料でダウンロードして、開発中にライブの Spark のデータ へのスキーマ対応アクセスを AI ツールに提供しましょう。本番環境に移行する際は、CData Spark Drivers が同じ SQL ベースのアクセスをエンタープライズグレードのパフォーマンス、セキュリティ、信頼性で提供します。

CData コミュニティにアクセスして、インサイトの共有や質問、MCP を活用した AI ワークフローの可能性を探索しましょう。