HDFS:

Apache Hadoop 分散ファイルシステム(HDFS)は、Hadoop クラスタの複数のノードにわたって大量の データ を保存および管理するように設計された分散ファイルシステムです。ビッグデータ の保存と処理のために、高可用性、耐障害性、スケーラビリティを提供します。HDFS は Apache Hadoop エコシステムの重要なコンポーネントです。

Apache Kafka:

Apache Kafka は、リアルタイムの大量データを処理するように設計されたオープンソースの分散イベントストリーミングプラットフォームです。さまざまなシステムとアプリケーションのシームレスな統合を可能にし、フォールトトレラントでスケーラブルな方法でデータの効率的な処理、保存、ストリーミングを可能にします。Kafka は、リアルタイムのデータパイプラインとストリーミングアプリケーションの構築に広く使用されています。

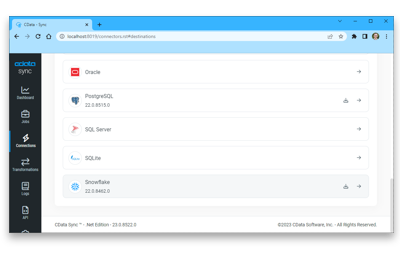

CData Sync で HDFS と Apache Kafka を統合

CData Sync を使えば、Apache HDFS データをデータベース・データレイク・データウェアハウスに継続的にレプリケーションし、分析・レポート・AI・機械学習にすぐ活用できます。

- Apache Kafka をはじめ、主要なデータベース・データウェアハウスにノーコードでデータを同期できます。

- HDFS データを Apache Kafka に自動レプリケート。手作業のエクスポートをなくし、BI・分析にすぐ活用できます。

- Apache Kafka にクエリをオフロードすることで、HDFS の API コール制限やパフォーマンス低下を回避できます。

- HDFS と BI ツールを連携し、データにもとづく迅速な意思決定を支援します。

- Apache HDFS データを Apache Kafka に自動バックアップ。万一のデータ消失に備えた仕組みを構築できます。

HDFS を Apache Kafka と統合

HDFS データ統合機能

シンプルなノーコード HDFS データ統合

複雑なコーディングは不要。ドラッグ&ドロップの直感的な操作で、HDFS データを任意の宛先に接続できます。

数分で構築できる手間のかからないデータパイプライン

増分更新と自動スキーマ検出で、一度設定すれば手間なし。Apache Kafka のデータを常に最新の状態に保てます。

行ごとの課金はありません

行数による従量課金はありません。HDFS と Apache Kafka 間のレプリケーション量を気にせず、必要なデータをすべて連携できます。

その他の HDFS データ統合ツール

HDFS からサポートされている任意のデータストアにデータを統合・レプリケートするデータパイプラインを簡単に作成できます: