Apache NiFi でDatabricks のデータにバッチ操作を実行

Apache NiFi は、データルーティング、変換、およびシステム間連携ロジックを強力かつスケーラブルに構築できるプラットフォームです。CData JDBC Driver for Databricks と組み合わせることで、NiFi からリアルタイムDatabricks のデータを操作できるようになります。この記事では、CSV ファイルからデータを読み取り、Apache NiFi(バージョン1.9.0 以降)でCData JDBC Driver forDatabricks のデータを使用してバッチ操作(INSERT/UPDATE/DELETE)を実行する方法を説明します。

最適化されたデータ処理が組み込まれたCData JDBC Driver は、リアルタイムDatabricks のデータを扱う上で比類のないパフォーマンスを提供します。Databricks に複雑なSQL クエリを発行すると、ドライバーはフィルタや集計などのサポートされているSQL 操作をDatabricks に直接プッシュし、サポートされていない操作(主にSQL 関数やJOIN 操作)は組み込みSQL エンジンを利用してクライアント側で処理します。組み込みの動的メタデータクエリを使用すると、ネイティブデータ型を使ってDatabricks のデータを操作・分析できます。

Databricks データ連携について

CData を使用すれば、Databricks のライブデータへのアクセスと統合がこれまでになく簡単になります。お客様は CData の接続機能を以下の目的で利用しています:

- Runtime バージョン 9.1 - 13.X から Pro および Classic Databricks SQL バージョンまで、すべてのバージョンの Databricks にアクセスできます。

- あらゆるホスティングソリューションとの互換性により、お好みの環境で Databricks を使用し続けることができます。

- パーソナルアクセストークン、Azure サービスプリンシパル、Azure AD など、さまざまな方法で安全に認証できます。

- Databricks ファイルシステム、Azure Blob ストレージ、AWS S3 ストレージを使用して Databricks にデータをアップロードできます。

多くのお客様が、さまざまなシステムから Databricks データレイクハウスにデータを移行するために CData のソリューションを使用していますが、ライブ接続ソリューションを使用して、データベースと Databricks 間の接続をフェデレートしているお客様も多数います。これらのお客様は、SQL Server リンクサーバーまたは Polybase を使用して、既存の RDBMS 内から Databricks へのライブアクセスを実現しています。

一般的な Databricks のユースケースと CData のソリューションがデータの問題解決にどのように役立つかについては、ブログをご覧ください:What is Databricks Used For? 6 Use Cases

はじめに

JDBC URL の生成

Apache NiFi からDatabricks のデータに接続するには、JDBC URL が必要です。

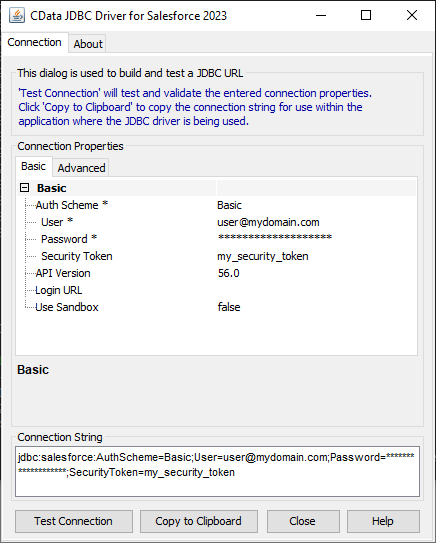

組み込みの接続文字列デザイナー

JDBC URL の作成をサポートするために、Databricks JDBC Driver に組み込まれている接続文字列デザイナーが使用できます。JAR ファイルをダブルクリックするか、コマンドラインからJAR ファイルを実行します。

java -jar cdata.jdbc.databricks.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

Databricks 接続プロパティの取得・設定方法

Databricks クラスターに接続するには、以下のプロパティを設定します。

- Database:Databricks データベース名。

- Server:Databricks クラスターのサーバーのホスト名。

- HTTPPath:Databricks クラスターのHTTP パス。

- Token:個人用アクセストークン。この値は、Databricks インスタンスのユーザー設定ページに移動してアクセストークンタブを選択することで取得できます。

Databricks への認証

CData は、次の認証スキームをサポートしています。

- 個人用アクセストークン

- Microsoft Entra ID(Azure AD)

- Azure サービスプリンシパル

- OAuthU2M

- OAuthM2M

個人用アクセストークン

認証するには、次を設定します。

- AuthScheme:PersonalAccessToken。

- Token:Databricks サーバーへの接続に使用するトークン。Databricks インスタンスのユーザー設定ページに移動してアクセストークンタブを選択することで取得できます。

その他の認証方法については、ヘルプドキュメント の「はじめに」セクションを参照してください。

Apache NiFi でのバッチ操作(INSERT/UPDATE/DELETE)

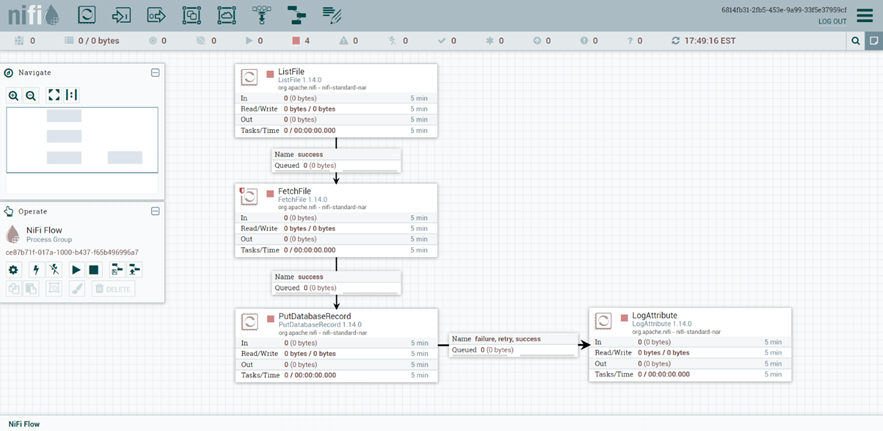

以下のサンプルフローは、次のNiFi プロセッサに基づいています:

- ListFile - ローカルファイルシステムからファイルリストを取得し、取得した各ファイルにFlowFile を作成します。

- FetchFile - ListFile プロセッサから受け取ったFlowFile のコンテンツを読み取ります。

- PutDatabaseRecord - 指定されたRecordReader を使用して、FetchFile プロセッサからのフローファイルからレコードを入力します。これらのレコードはSQL 文に変換され、単一のトランザクションとして実行されます。

- LogAttribute - 指定されたログレベルでFlowFile の属性を出力します。

完成したフローは以下のようになります:

注意事項

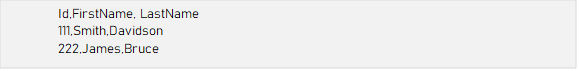

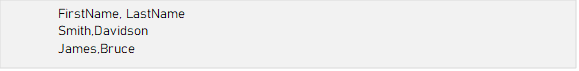

1. CSV ファイルのカラム名は、挿入/更新/削除するデータソーステーブルのレコードのカラム名と一致する必要があります。

2. Apache NiFi バージョン1.9.0 より前のバージョンでは、PutDatabaseRecord プロセッサの Maximum Batch Size プロパティがサポートされていません。

設定

バッチINSERT、UPDATE、またはDELETE を実行するには、NiFi プロセッサを以下のように設定します:

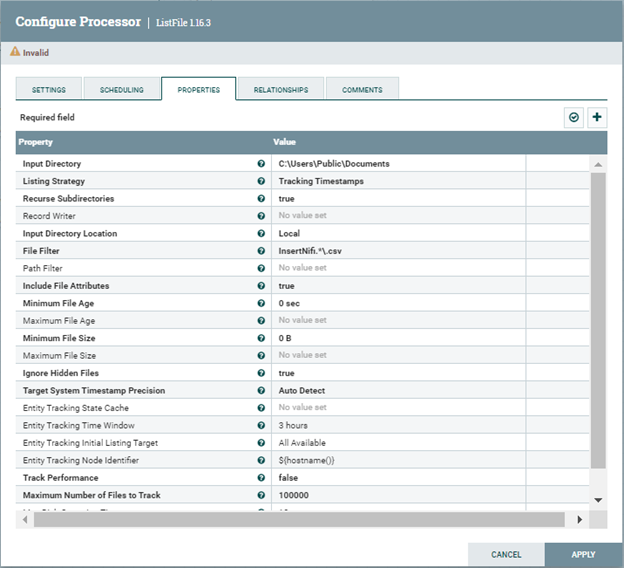

- ListFile プロセッサの設定:Input Directory プロパティを、CSV ファイルを取得するローカルフォルダパスに設定します。 File Filter プロパティを、名前が式に一致するファイルのみを選択する正規表現に設定します。 例:CSV ファイルのフルパスがC:\Users\Public\Documents\InsertNiFi.csv の場合、プロパティは以下の画像のように設定します:

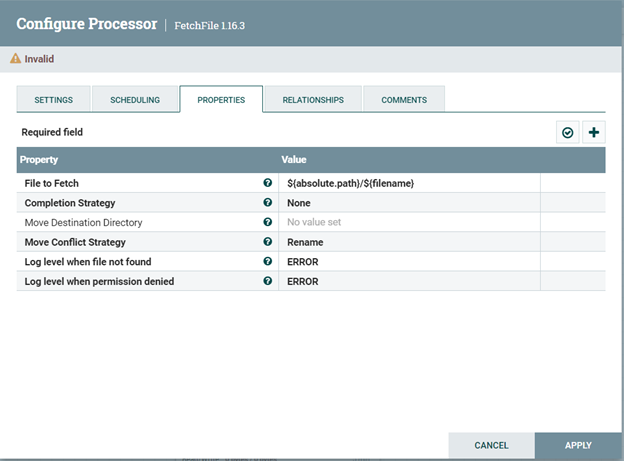

- FetchFile プロセッサの設定 FetchFile プロセッサのプロパティ設定はデフォルト値のままにします:

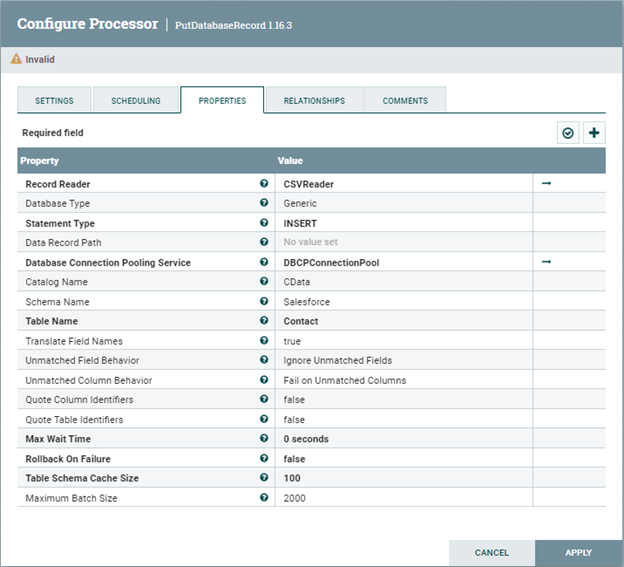

- PutDatabaseRecord プロセッサの設定

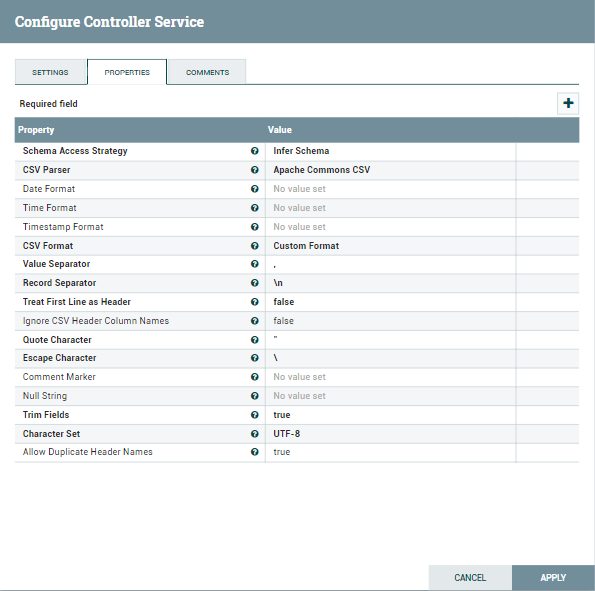

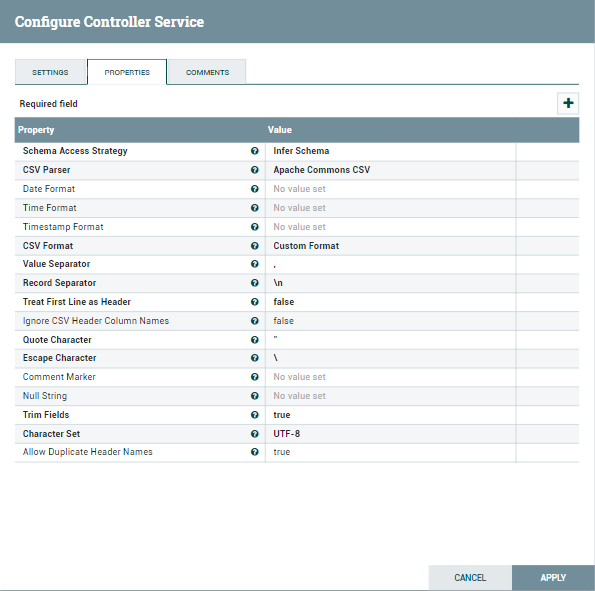

- Record Reader プロパティをCSV Reader Controller Service に設定します。CSV Reader Controller Service を、CSV ファイルの形式に合わせて設定します。

- Statement Type プロパティをINSERT に設定します。

-

Database Connection Pooling Service を、ドライバー設定を保持するDBCPConnection Pool に設定します。ドライバーはBulk API を使用するように設定する必要があります。

プロパティ 値 Database Connection URL jdbc:databricks:Server=127.0.0.1;HTTPPath=MyHTTPPath;User=MyUser;Token=MyToken; Database Driver Class Name cdata.jdbc.databricks.DatabricksDriver - Catalog Name プロパティを、テーブルが属するカタログの名前に設定します。

- Schema Name プロパティを、テーブルが属するスキーマの名前に設定します。

- Table Name プロパティを、INSERT 先のテーブル名に設定します。

-

Maximum Batch Size プロパティを、単一のバッチに含めるレコードの最大数に設定します。

-

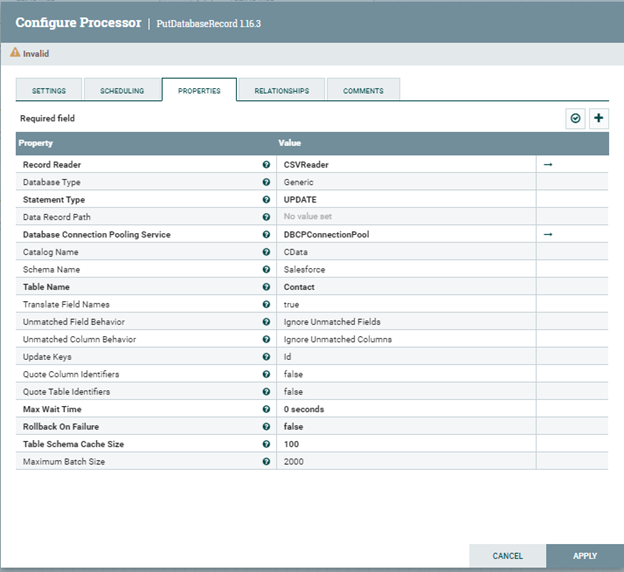

Record Reader プロパティをCSV Reader Controller Service に設定します。CSV Reader Controller Service を、CSV ファイルの形式に合わせて設定します。

- Statement Type プロパティをUPDATE に設定します。

- Database Connection Pooling Service を、ドライバー設定を保持するDBCPConnection Pool に設定します。ドライバーはBulk API を使用するように設定する必要があります。上記と同じDatabase Connection URL 形式を使用します。

- Catalog Name プロパティを、テーブルが属するカタログの名前に設定します。

- Schema Name プロパティを、テーブルが属するスキーマの名前に設定します。

- Table Name プロパティを、UPDATE 対象のテーブル名に設定します。

- Update Keys プロパティを、UPDATE に必要なカラム名に設定します。

-

Maximum Batch Size プロパティを、単一のバッチに含めるレコードの最大数に設定します。

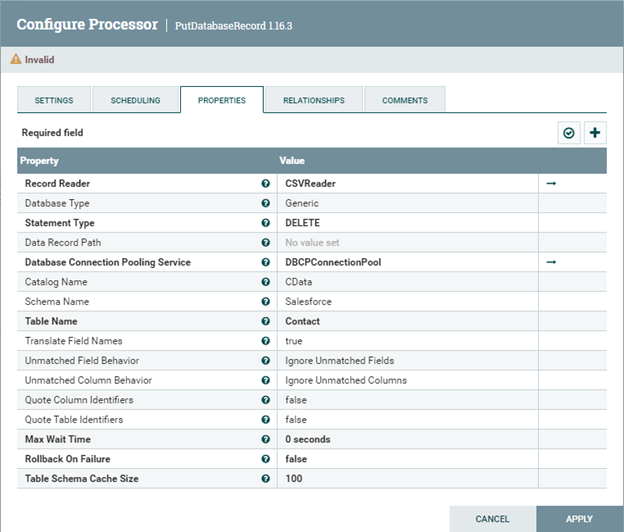

-

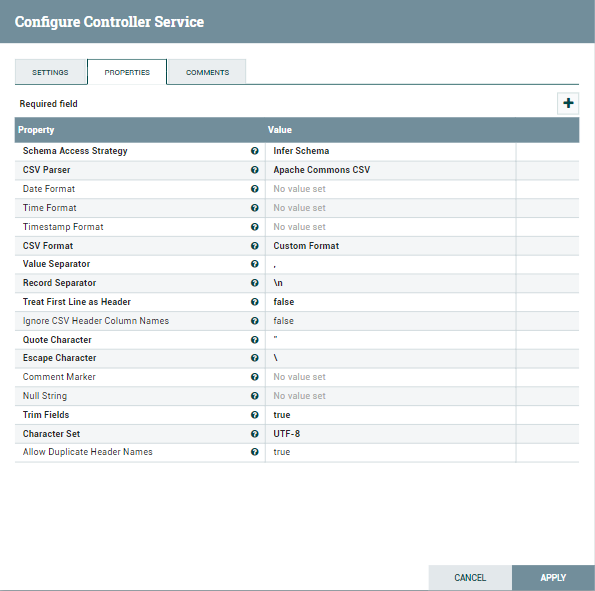

Record Reader プロパティをCSV Reader Controller Service に設定します。CSV Reader Controller Service を、CSV ファイルの形式に合わせて設定します。

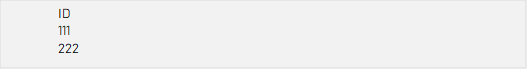

- Statement Type プロパティをDELETE に設定します。

- Database Connection Pooling Service を、ドライバー設定を保持するDBCPConnection Pool に設定します。ドライバーはBulk API を使用するように設定する必要があります。上記と同じDatabase Connection URL 形式を使用します。

- Catalog Name プロパティを、テーブルが属するカタログの名前に設定します。

- Schema Name プロパティを、テーブルが属するスキーマの名前に設定します。

- Table Name プロパティを、UPDATE 対象のテーブル名に設定します。

- INSERT やUPDATE のStatement Type とは異なり、DELETE 操作ではMaximum Batch Size プロパティは表示されません。ただし、操作は引き続きバッチで処理されます。変更しない場合、バッチあたりの最大レコード数はデフォルト値の2000 です。DELETE 操作で使用するMaximum Batch Size の値を変更するには、Statement Type をINSERT またはUPDATE に変更し、Maximum Batch Size プロパティの値を変更して「Apply Changes」をクリックします。最後に、プロセッサの設定を再度開き、Statement Type をDELETE に戻して「Apply Changes」をクリックします。

-

LogAttribute プロセッサの設定

最後に、LogAttribute プロセッサを設定して、ユースケースに基づいてログに記録または無視する属性とログレベルを指定します。

INSERT 操作

バッチINSERT 操作を実行するには、PutDatabaseRecord プロセッサを以下のように設定します:

UPDATE 操作

バッチUPDATE 操作を実行するには、PutDatabaseRecord プロセッサを以下のように設定します:

DELETE 操作

バッチDELETE 操作を実行するには、PutDatabaseRecord プロセッサを以下のように設定します:

無償トライアルと詳細情報

CData JDBC Driver for Databricks の30日間無償トライアルをダウンロードして、Apache NiFi でリアルタイムDatabricks のデータの操作をはじめましょう。ご不明な点があれば、サポートチームにお問い合わせください。