Pentaho Data Integration でHDFS のデータを連携

CData JDBC Driver for HDFS を使用すると、データパイプラインからリアルタイムデータにアクセスできます。Pentaho Data Integration は、ETL(Extraction, Transformation, and Loading)エンジンであり、データをクレンジングし、アクセス可能な統一フォーマットでデータを格納します。この記事では、HDFS のデータ に JDBC データソースとして接続し、Pentaho Data Integration で HDFS のデータ をベースにしたジョブやトランスフォーメーションを構築する方法を説明します。

HDFS への接続を設定

HDFS 接続プロパティの取得・設定方法

HDFS への認証には、次の接続プロパティを設定します。

- Host:HDFS インスタンスのホストに設定。

- Port:HDFS インスタンスのポートに設定。デフォルトのポートは"9870" です。

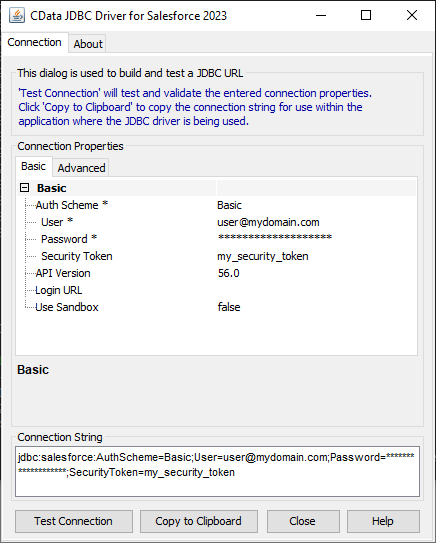

組み込みの接続文字列デザイナー

JDBC URL の構築を支援するには、HDFS JDBC Driver に組み込まれている接続文字列デザイナーを使用してください。JAR ファイルをダブルクリックするか、コマンドラインから JAR ファイルを実行します。

java -jar cdata.jdbc.hdfs.jar

接続プロパティを設定し、接続文字列をクリップボードにコピーします。

JDBC URL を設定する際には、Max Rows 接続プロパティの設定も検討してください。これにより返される行数が制限され、レポートやビジュアライゼーションの設計時にパフォーマンスを向上させることができます。

一般的な JDBC URL は次のようになります:

jdbc:hdfs:Host=sandbox-hdp.hortonworks.com;Port=50070;Path=/user/root;User=root;

接続文字列を保存して、Pentaho Data Integration で使用します。

Pentaho DI から HDFS に接続

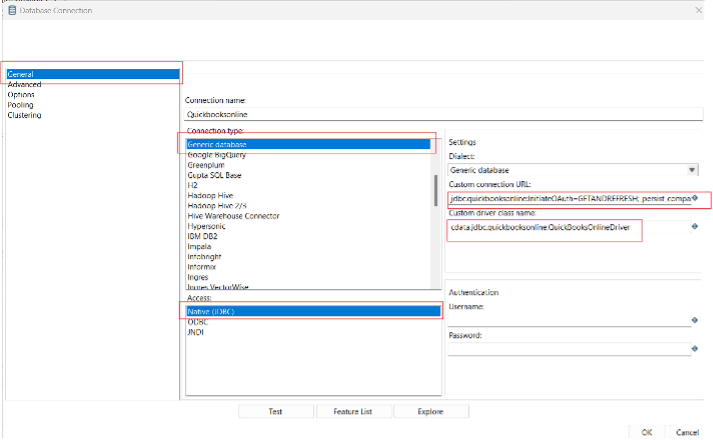

Pentaho Data Integration を開き、「Database Connection」を選択して CData JDBC Driver for HDFS への接続を設定します。

- 「General」をクリックします。

- Connection name を設定します(例:HDFS Connection)。

- Connection type を「Generic database」に設定します。

- Access を「Native (JDBC)」に設定します。

- Custom connection URL に HDFS の接続文字列を設定します(例:

jdbc:hdfs:Host=sandbox-hdp.hortonworks.com;Port=50070;Path=/user/root;User=root;

)。 - Custom driver class name を「cdata.jdbc.hdfs.HDFSDriver」に設定します。

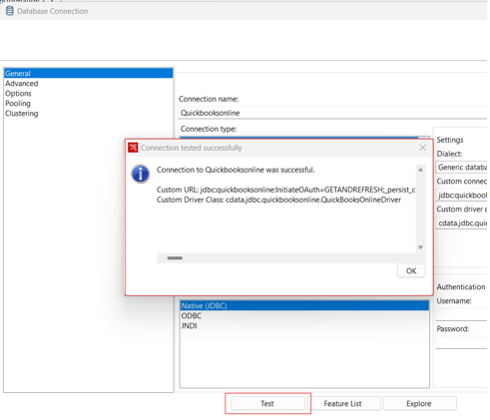

- 接続をテストし、「OK」をクリックして保存します。

HDFS のデータパイプラインを作成

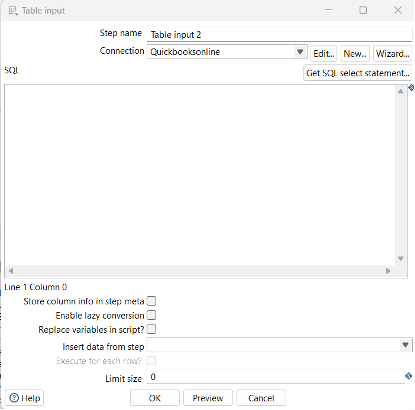

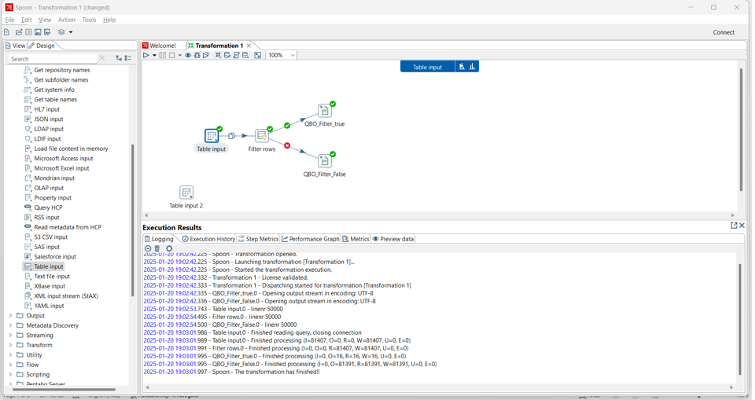

CData JDBC Driver を使用して HDFS への接続が設定されたら、新しいトランスフォーメーションまたはジョブを作成する準備が整いました。

- 「File」>>「New」>>「Transformation/job」をクリックします。

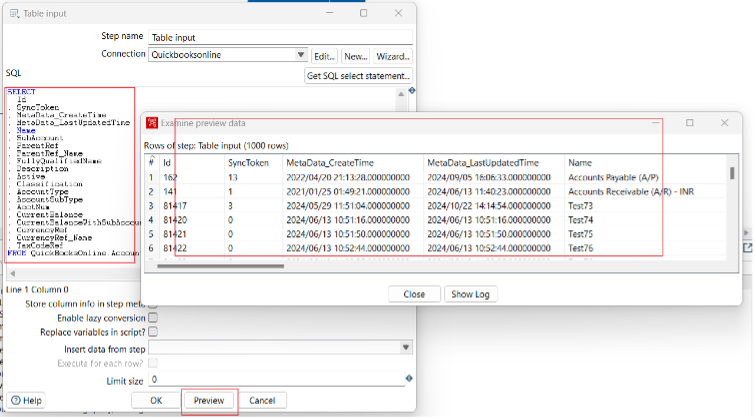

- 「Table input」オブジェクトをワークフローパネルにドラッグし、HDFS 接続を選択します。

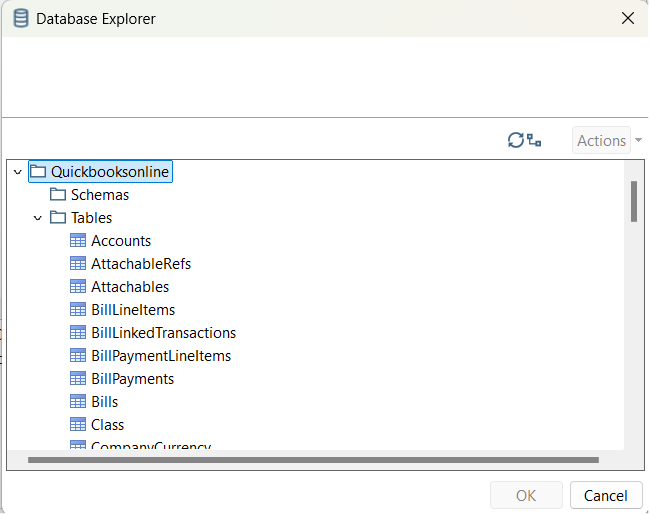

- 「Get SQL select statement」をクリックし、Database Explorer を使用して利用可能なテーブルとビューを表示します。

- テーブルを選択し、必要に応じてデータをプレビューして確認します。

ここから、適切な同期先を選択し、レプリケーション中にデータを変更、フィルタリング、その他の処理を行うトランスフォーメーションを追加することで、トランスフォーメーションまたはジョブを続行できます。

無料トライアルと詳細情報

CData JDBC Driver for HDFS の 30日間無料トライアルをダウンロードして、Pentaho Data Integration で HDFS のデータ のリアルタイムデータを今すぐ活用しましょう。