Google Data Fusion で Redshift に連携した ETL プロセスを作成

Google Data Fusion を使用すると、セルフサービス型のデータ連携を行い、異なるデータソースを統合できます。CData JDBC Driver for Amazon Redshift をアップロードすることで、Google Data Fusion のパイプライン内から Redshift のデータ にリアルタイムでアクセスできるようになります。CData JDBC Driver を使用すると、Redshift のデータ を Google Data Fusion でネイティブにサポートされている任意のデータソースにパイプできますが、この記事では、Redshift から Google BigQuery へデータをパイプする方法を説明します。

CData JDBC Driver for Amazon Redshift を Google Data Fusion にアップロード

CData JDBC Driver for Amazon Redshift を Google Data Fusion インスタンスにアップロードして、Redshift のデータ にリアルタイムでアクセスしましょう。Google Data Fusion では JDBC ドライバーの命名規則に制限があるため、JAR ファイルを driver-version.jar という形式に合わせてコピーまたはリネームしてください。例:cdataredshift-2020.jar

- Google Data Fusion インスタンスを開きます

- をクリックしてエンティティを追加し、ドライバーをアップロードします

- "Upload driver" タブで、リネームした JAR ファイルをドラッグまたは参照します。

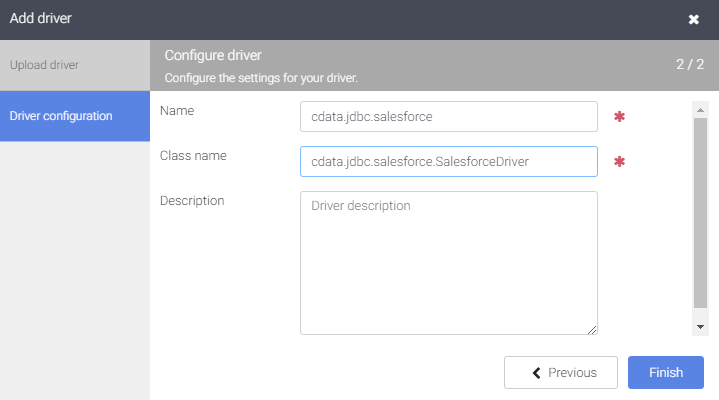

- "Driver configuration" タブで以下を設定します:

- Name: ドライバーの名前(cdata.jdbc.redshift)を作成し、メモしておきます

- Class name: JDBC クラス名を設定します:(cdata.jdbc.redshift.RedshiftDriver)

- "Finish" をクリックします

Google Data Fusion で Redshift のデータ に接続

JDBC Driver をアップロードしたら、Google Data Fusion のパイプラインで Redshift のデータ にリアルタイムでアクセスできます。

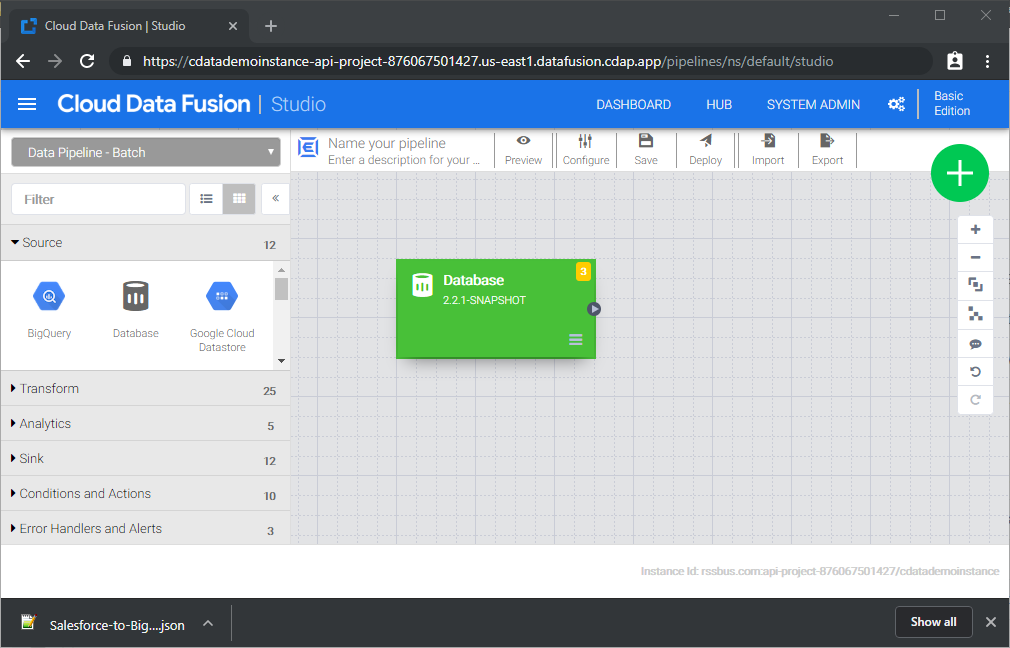

- Pipeline Studio に移動して、新しいパイプラインを作成します

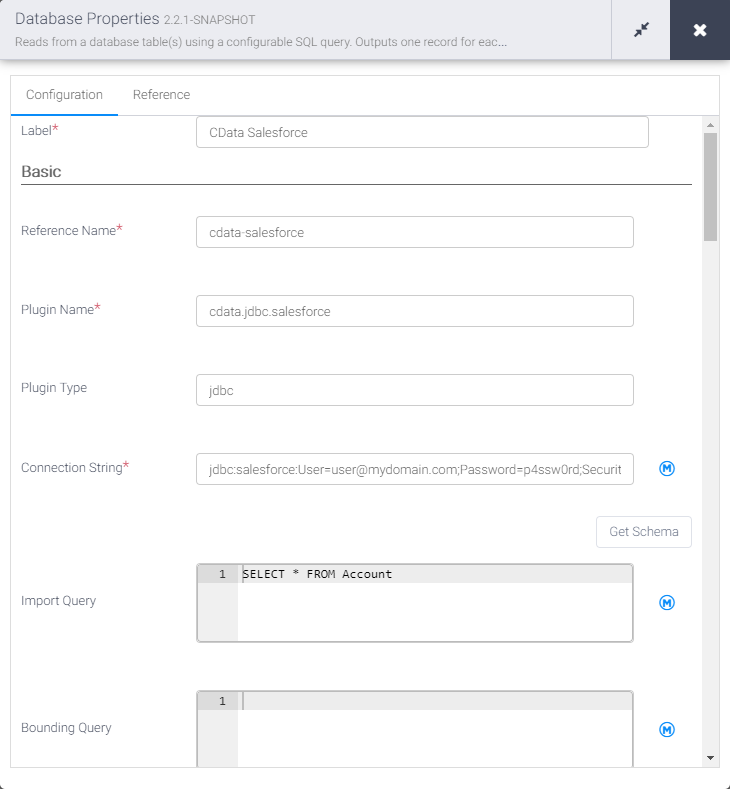

- "Source" オプションから "Database" をクリックして、JDBC Driver 用のソースを追加します

- Database ソースの "Properties" をクリックしてプロパティを編集します

NOTE:Google Data Fusion で JDBC Driver を使用するには、ライセンス(製品版またはトライアル)とランタイムキー(RTK)が必要です。ライセンス(またはトライアル)の取得については、CData までお問い合わせください。

- Label を設定します

- Reference Name を将来の参照用の値に設定します(例:cdata-redshift)

- Plugin Type を "jdbc" に設定します

- Connection String を Redshift の JDBC URL に設定します。例:

jdbc:redshift:RTK=5246...;User=admin;Password=admin;Database=dev;Server=examplecluster.my.us-west-2.redshift.amazonaws.com;Port=5439;Amazon Redshift への接続

それでは、早速Amazon Redshift に接続していきましょう。データに接続するには、以下の接続パラメータを指定します。

- Server:Amazon Redshift データベースをホスティングしているサーバーのホスト名またはIP アドレス

- Database:Amazon Redshift クラスター用に作成したデータベース

- Port(オプション):Amazon Redshift データベースをホスティングしているサーバーのポート。デフォルトは5439です

これらの値は、以下のステップでAWS マネージメントコンソールから取得できます。

- Amazon Redshift コンソールを開きます(http://console.aws.amazon.com/redshift)

- Clusters ページで、クラスター名をクリックしてください

- Configuration タブの"Cluster Database Properties" セクションからプロパティを取得します。接続プロパティの値は、ODBC URL で設定された値と同じになります

Amazon Redshiftへの認証

CData 製品では幅広い認証オプションに対応しています。標準認証情報からIAM クレデンシャル、ADFS、Ping Federate、Microsoft Entra ID(Azure AD)、Azure AD PKCE まで利用可能です。標準認証

ログイン資格情報を使用してAmazon Redshift に接続するには、以下のプロパティを設定してみましょう。- AuthScheme:Basic

- User:認証するユーザーのログイン情報

- Password:認証するユーザーのパスワード

その他の認証方法については、ヘルプドキュメントをご確認ください。

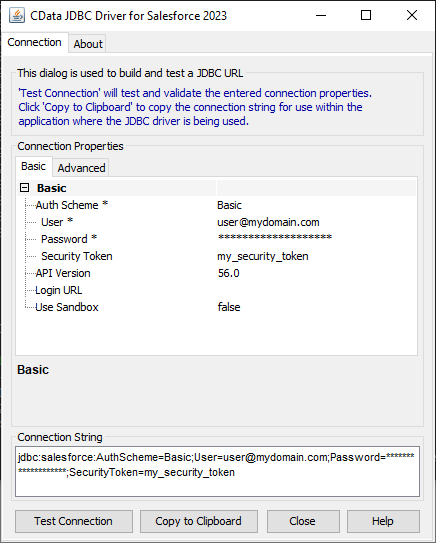

ビルトイン接続文字列デザイナー

JDBC URL の作成には、Redshift JDBC Driver に組み込まれている接続文字列デザイナーを使用できます。JAR ファイルをダブルクリックするか、コマンドラインから JAR ファイルを実行してください。

java -jar cdata.jdbc.redshift.jar接続プロパティを入力し、接続文字列をクリップボードにコピーします。

- Import Query を Redshift から取得したいデータを抽出する SQL クエリに設定します。例:

SELECT * FROM Orders

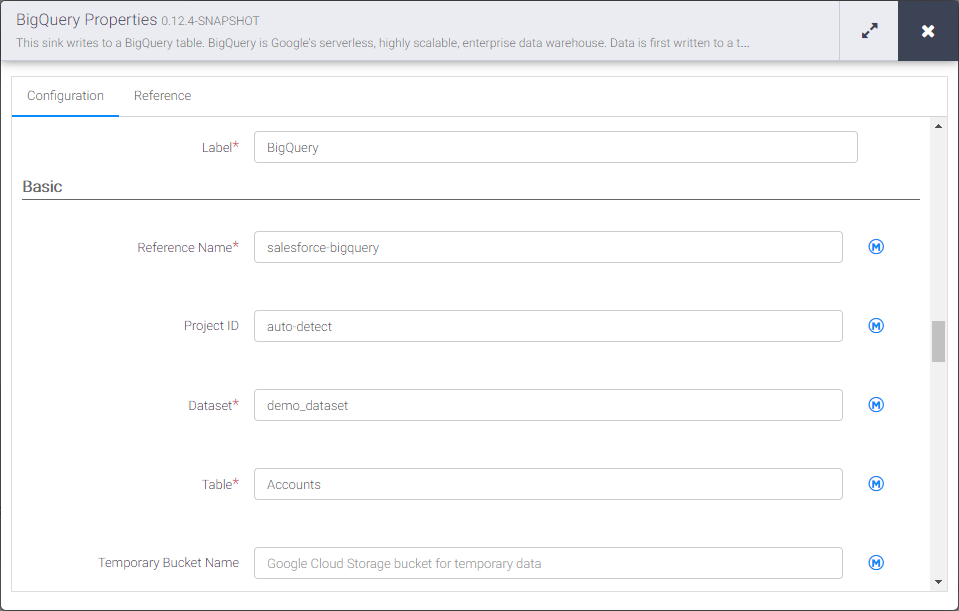

- "Sink" タブから、同期先シンクを追加します(この例では Google BigQuery を使用します)

- BigQuery シンクの "Properties" をクリックしてプロパティを編集します

- Label を設定します

- Reference Name を redshift-bigquery のような値に設定します

- Project ID を特定の Google BigQuery プロジェクト ID に設定します(またはデフォルトの "auto-detect" のままにします)

- Dataset を特定の Google BigQuery データセットに設定します

- Table を Redshift のデータ を挿入するテーブル名に設定します

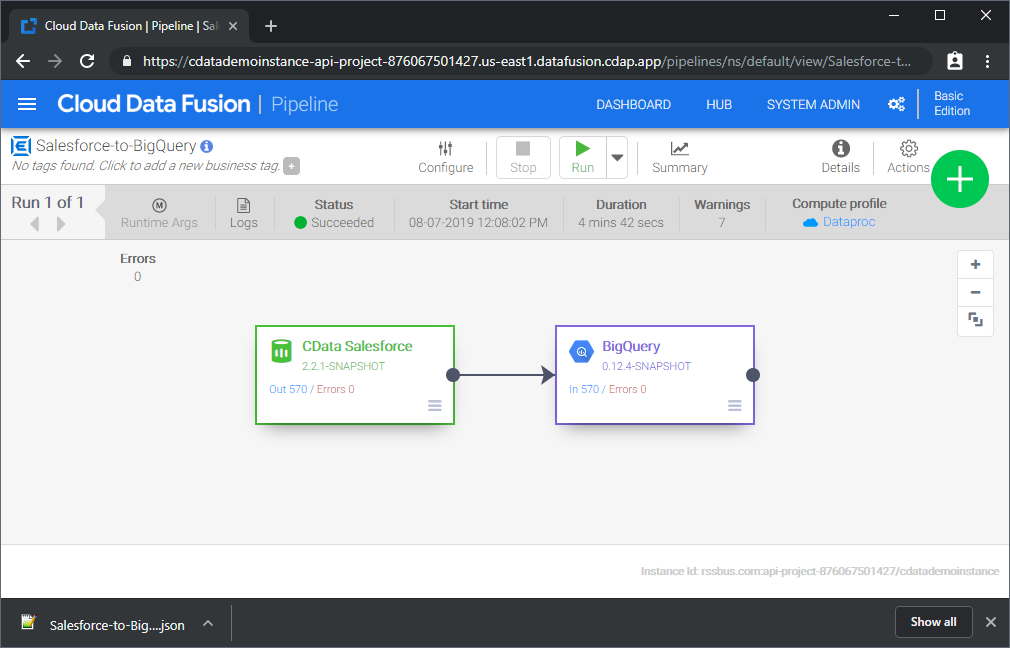

Source と Sink を設定すると、Redshift のデータ を Google BigQuery にパイプする準備が整います。パイプラインを保存してデプロイしてください。パイプラインを実行すると、Google Data Fusion が Redshift からリアルタイムデータをリクエストし、Google BigQuery にインポートします。

これはシンプルなパイプラインの例ですが、変換、分析、条件などを使用してより複雑な Redshift パイプラインを作成できます。CData JDBC Driver for Amazon Redshift の 30日間の無償トライアルをダウンロードして、今すぐ Google Data Fusion で Redshift のデータ をリアルタイムで活用しましょう。