Hive:

Apache Hive は、Hadoop の分散ファイルシステムに保存された大規模なデータセットを照会および分析するための、Hadoop 上に構築されたオープンソースのデータウェアハウス(DWH)インフラストラクチャです。ユーザーがクエリを記述するための SQL ライクなインターフェースを提供し、構造化データと半構造化データの要約、アドホッククエリ、分析をサポートします。

Apache Kafka:

Apache Kafka は、リアルタイムの大量データを処理するように設計されたオープンソースの分散イベントストリーミングプラットフォームです。さまざまなシステムとアプリケーションのシームレスな統合を可能にし、フォールトトレラントでスケーラブルな方法でデータの効率的な処理、保存、ストリーミングを可能にします。Kafka は、リアルタイムのデータパイプラインとストリーミングアプリケーションの構築に広く使用されています。

CData Sync で Hive と Apache Kafka を統合

CData Sync を使えば、Apache Hive データをデータベース・データレイク・データウェアハウスに継続的にレプリケーションし、分析・レポート・AI・機械学習にすぐ活用できます。

- Apache Kafka をはじめ、主要なデータベース・データウェアハウスにノーコードでデータを同期できます。

- Hive データを主要なデータベース・データウェアハウスに自動レプリケートし、運用レポートや BI・分析に活用できます。

- Hive へのクエリをオフロードすることで、負荷を軽減しパフォーマンスを向上させます。

- Hive をビジネス分析ツールと連携し、BI や意思決定を支援します。

- Apache Hive データをアーカイブし、ディザスタリカバリに備えます。

Hive を Apache Kafka と統合

Hive データ統合機能

複雑なコードやセットアップは不要。短時間でより多くのデータを移動できます。Hive を任意の同期先に簡単に接続できます。

増分更新と自動スキーマレプリケーションにより、Hive データ統合の手間が省け、Apache Kafka には常に最新データが保持されます。

予測可能で透明性の高い料金体系で、必要なすべてのデータをレプリケート。Hive と Apache Kafka の間で無制限にレプリケーションできます。

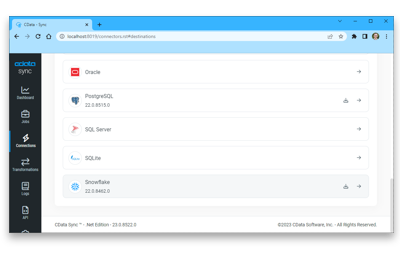

その他の Hive データ統合ツール

Hive からサポートされている任意のデータストアにデータを統合・レプリケートするデータパイプラインを簡単に作成できます: